相关性分析及回归分析

- 格式:pptx

- 大小:1.25 MB

- 文档页数:29

相关分析和回归分析的实践报告总结下载提示:该文档是本店铺精心编制而成的,希望大家下载后,能够帮助大家解决实际问题。

文档下载后可定制修改,请根据实际需要进行调整和使用,谢谢!本店铺为大家提供各种类型的实用资料,如教育随笔、日记赏析、句子摘抄、古诗大全、经典美文、话题作文、工作总结、词语解析、文案摘录、其他资料等等,想了解不同资料格式和写法,敬请关注!Download tips: This document is carefully compiled by this editor. I hope that after you download it, it can help you solve practical problems. The document can be customized and modified after downloading, please adjust and use it according to actual needs, thank you! In addition, this shop provides you with various types of practical materials, such as educational essays, diary appreciation, sentence excerpts, ancient poems, classic articles, topic composition, work summary, word parsing, copy excerpts, other materials and so on, want to know different data formats and writing methods, please pay attention!相关分析和回归分析的实践报告总结在数据分析领域,相关分析和回归分析是两种常见的统计方法,用于探究变量之间的关系和预测未来趋势。

相关性与回归分析4.3.4.1相关性分析相关性分析定义:相关性分析是确定两个连续变量之间是否存在线性关系。

相关性分析的用途:相关性分析是一种统计工具,如果两个变量是相关的并且存在因果关系,那么我们可以考虑使用回归分析来创建一个预测方程来进一步描述这种关系。

相关系数r●相关系数r:用于量化线性关系的强度;●范围从-1到1;●接近-1或1的相关系数表示强线性关系,相关系数接近0表示或非线性关系。

相关系数r 的值反映了相关的强度和方向。

案例:如果不绘制数据,相关系数可能会产生误导,如下例子,其中r = 0.238尽管相关系数表示弱线性关系,但图形显示强曲线关系-始终绘制数据相关VS因果例如,犯罪率和冰淇淋销售之间的相关系数为r=0.96,那么强相关系数是否意味着因果关系?高冰激凌销量会导致高犯罪率吗?相关性只意味着存在一种线性关系,而未必是因果关系。

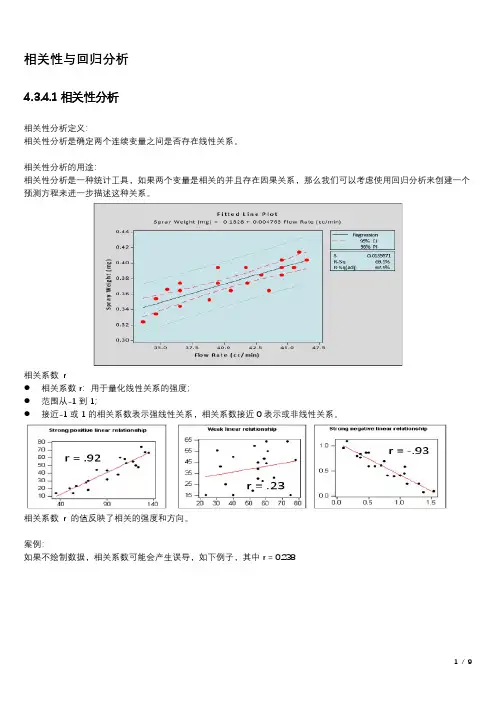

相关性分析案例:黑带想知道在更高的流速和更多附着在灯丝上的物质之间是否存在线性关系?收集历史数据并计算相关系数。

相关检验的原假设是相关系数r=0(更高的流速和更多附着在灯丝上的物质之间无线性关系),备择假设是相关系数r ≠0(更高的流速和更多附着在灯丝上的物质之间有线性关系)。

●p > 0.05,无法拒绝原假设,更高的流速和更多附着在灯丝上的物质之间无线性关系(无显著性差异);●p < 0.05,拒绝原假设,更高的流速和更多附着在灯丝上的物质之间有线性关系(有显著性差异)。

复制数据-统计(S)-基本统计(B)-相关(C):变量(V):点击C15、C16?-方法(M):选择pearson相关系数-点击显示P值(D)-确定P值决定了统计的显著性,皮尔逊相关系数r = 0.834为正,正相关,中等强度(较强)相关性。

判定准则(结论):p值= 0.000 < 0.05,拒绝原假设,接收备择假设,更高的流速和更多附着在灯丝上的物质之间有线性关系。

皮尔逊相关系数r = 0.834,为较强的正相关。

报告中的多元回归和相关性分析引言:多元回归和相关性分析是统计学中常用的分析方法,它们能够帮助我们理解变量之间的关系,从而做出科学的预测和决策。

本文将详细讨论多元回归和相关性分析的相关概念、方法和应用,并结合实际案例进行解析。

一、多元回归分析多元回归分析是一种建立数学模型,通过统计方法探究因变量与多个自变量之间的关系的分析方法。

它可以帮助我们确定自变量对因变量的影响程度,并揭示变量之间的相互作用。

在多元回归分析中,我们需要解决共线性、选择合适的变量和模型拟合等问题,通过逐步回归法和变量筛选等方法进行优化。

二、多元回归的应用1. 预测房价通过多元回归分析来预测房价是房地产行业常用的方法。

我们可以将房价作为因变量,面积、位置、房屋年龄等因素作为自变量,建立回归模型来预测房价。

通过分析模型的系数和显著性水平,我们可以了解各自变量对房价的影响程度,为购房者和开发商提供决策依据。

2. 分析消费者行为在市场营销中,多元回归分析可以帮助企业了解消费者行为和购买决策的影响因素。

例如,我们可以将销售量作为因变量,广告投入、促销力度、竞争对手销售量等因素作为自变量,建立回归模型来分析各个因素对销售量的影响。

通过分析模型结果,企业可以制定有针对性的市场策略,以提高销售业绩。

三、相关性分析相关性分析是一种用于测量两个变量之间关系强度的统计方法。

它可以帮助我们了解变量之间的相关关系,进一步了解变量的影响机制。

在相关性分析中,我们通常使用皮尔逊相关系数、斯皮尔曼相关系数等指标来度量相关关系的程度。

四、相关性分析的应用1. 测量市场风险在金融领域,相关性分析可以帮助投资者测量不同资产的相关关系,从而评估市场风险。

通过计算各资产之间的相关系数,投资者可以了解资产之间的关联程度,从而进行风险分散和资产配置。

2. 确定特征与目标的相关性在机器学习和数据挖掘领域,相关性分析可以帮助我们确定输入特征与目标变量之间的相关性。

通过分析各个特征与目标变量的相关系数,我们可以选择最有价值的特征,提高机器学习模型的准确性和解释能力。

数据分析中的相关系数与回归分析数据分析是一门重要的学科,它通过收集、整理和分析数据来揭示数据背后的信息和规律。

在数据分析的过程中,相关系数和回归分析是两个常用的分析方法。

本文将介绍相关系数和回归分析的概念、计算方法以及应用场景。

一、相关系数相关系数用于衡量两个变量之间的相关性强度。

在数据分析中,我们经常会遇到多个变量之间的相互影响关系。

相关系数可以帮助我们了解这些变量之间的联系程度,从而更好地进行数据分析和决策。

计算相关系数的常用方法是皮尔逊相关系数(Pearson correlation coefficient)。

该系数的取值范围在-1到1之间,取值接近1表示两个变量呈正相关关系,取值接近-1表示两个变量呈负相关关系,取值接近0表示两个变量之间没有线性相关关系。

相关系数的计算可以使用公式:其中,n表示样本容量,X和Y分别表示两个变量的观测值,X的均值为μX,Y的均值为μY。

通过计算协方差和标准差,可以得到两个变量之间的相关系数。

相关系数在许多领域有着广泛的应用。

例如,在金融领域,相关系数可以用于衡量不同投资品之间的相关性,从而帮助投资者构建更加稳健和多样化的投资组合。

在医学研究中,相关系数可以用于分析药物疗效和副作用之间的关系。

在市场调研中,相关系数可以用于评估产品销售和广告投放之间的关联性。

二、回归分析回归分析是一种通过建立数学模型来预测和解释变量之间关系的方法。

它可以帮助我们了解一个或多个自变量对因变量的影响程度,并进行预测和推断。

回归分析的常用方法包括线性回归、多项式回归、逻辑回归等。

在这些方法中,线性回归是最常用的一种。

线性回归通过建立一个线性方程来描述自变量和因变量之间的关系。

例如,当只有一个自变量和一个因变量时,线性回归可以表示为:其中,Y表示因变量,X表示自变量,β0和β1表示回归系数,ε表示误差项。

回归分析的目标是通过拟合找到最佳的回归系数,使得拟合值尽可能接近实际观测值。

简述数学中的回归分析与相关性检验回归分析和相关性检验是数学中常用的两种统计方法,用于研究变量之间的关系和进行预测分析。

本文将简要介绍回归分析和相关性检验的基本概念和应用。

一、回归分析回归分析是一种用于研究自变量和因变量之间关系的统计方法。

它通过建立一个数学模型,来描述自变量对因变量的影响程度和趋势。

回归分析常用于预测和解释变量之间的关系,同时还可以用于控制其他因素对因变量的影响。

在回归分析中,自变量通常是独立变量,而因变量是被解释或预测的变量。

回归分析的基本原理是找到最佳拟合的直线或曲线,使得因变量的观测值与预测值之间的误差最小。

常见的回归分析方法包括线性回归、多元回归、非线性回归等。

线性回归是最常见的回归分析方法之一,它假设自变量和因变量之间存在线性关系。

线性回归模型可以表示为:Y = β0 + β1X + ε,其中Y表示因变量,X表示自变量,β0和β1表示回归系数,ε表示误差项。

通过最小二乘法可以估计出回归系数的值,进而进行预测和推断。

多元回归是一种包含多个自变量的回归分析方法。

它可以用于研究多个自变量对因变量的影响,并控制其他因素的影响。

多元回归模型可以表示为:Y = β0 + β1X1 + β2X2 + ... + βnXn + ε,其中X1、X2、...、Xn表示多个自变量。

非线性回归是一种用于研究非线性关系的回归分析方法。

它通过拟合非线性函数来描述自变量和因变量之间的关系。

非线性回归模型的形式可以根据具体问题进行选择,例如指数模型、对数模型、幂函数模型等。

回归分析广泛应用于各个领域,例如经济学、社会学、医学等。

它可以帮助研究人员理解变量之间的关系,预测未来趋势,以及进行决策和政策制定。

二、相关性检验相关性检验是一种用于判断两个变量之间关系强度和方向的统计方法。

它可以帮助研究人员确定变量之间是否存在相关性,以及相关性的程度。

常用的相关性检验方法包括皮尔逊相关系数、斯皮尔曼相关系数等。

皮尔逊相关系数用于度量两个连续变量之间的线性相关性,取值范围在-1到1之间。

相关分析与回归分析的基本原理1. 引言相关分析与回归分析是统计学中常用的两种数据分析方法,它们可以帮助研究者理解变量之间的关系,并根据这些关系进行预测。

本文将介绍相关分析和回归分析的基本原理,包括其定义、应用场景以及计算方法。

2. 相关分析2.1 定义相关分析是一种用来研究两个或多个变量之间关系的统计方法。

它通过计算相关系数来衡量变量之间的相关性。

相关系数的取值范围为-1到1,其中-1表示完全的负相关,1表示完全的正相关,0表示无相关关系。

2.2 应用场景相关分析可应用于许多领域,如市场研究、医学研究、金融分析等。

例如,在市场研究中,我们可以使用相关分析来研究产品销量与广告投入之间的关系,了解其相关性,并根据相关性进行决策。

2.3 计算方法计算两个变量之间的相关系数可以使用皮尔逊相关系数或斯皮尔曼相关系数。

皮尔逊相关系数适用于连续变量,而斯皮尔曼相关系数适用于有序变量或非线性关系。

3. 回归分析3.1 定义回归分析是一种用来研究变量之间关系的统计方法,其基本思想是通过构建适当的数学模型来描述一个或多个自变量对因变量的影响。

回归分析可以帮助预测未来的观察值,并理解变量之间的因果关系。

3.2 应用场景回归分析可以应用于各种预测和建模的场景。

例如,在金融领域,回归分析可以用来预测股票价格的变动,了解影响股价的各种因素,并根据这些因素进行投资决策。

3.3 计算方法回归分析通常使用最小二乘法来拟合变量间的线性关系。

在回归分析中,自变量可以是单个变量或多个变量,而因变量是需要预测或解释的变量。

通过最小化残差平方和,可以得到最佳拟合的回归模型。

4. 相关分析与回归分析的联系与区别4.1 联系相关分析和回归分析都是用来研究变量之间关系的统计方法,它们都可以帮助研究者理解变量之间的相关性和影响程度。

4.2 区别相关分析主要关注变量之间的相关性,通过计算相关系数来衡量相关性的强度和方向;而回归分析则更加关注自变量对因变量的影响程度和预测能力,适用于建立因果关系和预测模型。

相关分析和回归分析相关分析和回归分析是统计学中最基础的两种分析方法,它们都用于研究数据变量之间的关系。

因为它们都是研究两个变量之间关系的,所以它们常常会被混淆起来,但它们其实在原理上是不同的,有不同的应用场景。

一、相关分析相关分析是一种简单的统计分析,用来检验不同变量之间是否存在相互关系。

它可以通过计算出变量之间的相关系数,来判断变量之间是线性关系还是非线性关系。

另外,它还可以度量两个变量的线性关系的相关程度,用来度量不同变量之间的关系强度。

相关分析的应用非常广泛,它可以帮助研究者了解数据之间的关系,也可以用来预测数据的变化趋势。

比如,可以用相关分析来研究一个地区的薪水水平和就业水平之间的关系,用来预测未来就业水平和薪资水平会有怎样的变化趋势。

二、回归分析回归分析是一种统计分析,用以研究两个变量之间的数量关系,并建立起变量之间的数量模型。

它用于预测和分析数据,从而探索数据之间的关系。

比如,从客户收入、购买频率等多个因素来建立一个回归模型,从而预测客户的未来购买意愿。

回归分析也是一种非常有用的统计方法,它可以用来研究数据之间的关系,并预测数据未来的变化趋势。

另外,它还可以用来预测特定变量的值,比如预测未来股市的涨跌情况。

总结以上就是相关分析和回归分析的基本内容介绍。

相关分析用于研究数据变量之间的关系,可以帮助研究者了解数据之间的关系,并预测数据的变化趋势;而回归分析是一种统计分析,用以研究两个变量之间的数量关系,可以用来预测特定变量的值,也可以研究数据之间的关系,并预测数据未来的变化趋势。

相关分析和回归分析可以说是统计学中最基础的两种分析方法,它们都具有重要的应用价值,广泛用于各种数据分析工作。

回归分析与相关分析的概念与应用回归分析和相关分析是统计学中常用的两种数据分析方法,它们可以帮助我们理解和解释变量之间的关系。

本文将介绍回归分析和相关分析的概念以及它们在实际应用中的用途。

一、回归分析的概念与应用回归分析是一种用于研究变量之间关系的方法。

它通过建立一个数学模型来描述自变量与因变量之间的关系,并使用统计方法对模型进行评估。

在回归分析中,我们需要选择一个合适的回归模型,并利用样本数据来估计模型参数。

回归分析可以应用于各种场景,例如市场营销、经济预测和医学研究等。

以市场营销为例,我们可以使用回归分析来研究广告投入与销售额之间的关系,从而制定更有效的营销策略。

此外,回归分析还可以用于预测未来的趋势和模式,帮助决策者做出准确的预测。

二、相关分析的概念与应用相关分析是用来衡量两个变量之间关系强度的统计方法。

它可以告诉我们这两个变量是否呈现线性相关,并给出相关系数来表示相关程度。

相关系数的取值范围是-1到1,当相关系数接近于-1时,表示负相关;当相关系数接近于1时,表示正相关;当相关系数接近于0时,表示无相关关系。

相关分析被广泛应用于各个领域,例如社会科学研究、金融分析和环境监测等。

在社会科学研究中,我们可以利用相关分析来研究教育水平与收入之间的关系,以及人口密度与犯罪率之间的关系。

通过分析相关性,我们可以发现变量之间的内在联系,进而做出有针对性的政策或决策。

三、回归分析与相关分析的联系与区别回归分析和相关分析都是用来研究变量之间关系的统计方法,但它们有一些区别。

首先,回归分析关注的是因变量与自变量之间的关系,并通过建立模型来预测因变量的取值。

而相关分析则更加关注变量之间的相关程度,并不涉及因果关系的解释。

其次,回归分析假设因变量与自变量之间存在一种函数关系,而相关分析只是衡量两个变量之间的相关性,并不要求存在具体的函数形式。

因此,回归分析可以进行更加深入的解释和预测,而相关分析则更加简单直观。

报告中的相关性分析与回归模型相关性分析和回归模型是统计学中常用的分析方法,在报告中它们经常被应用于数据的解读和预测。

本文将从六个方面展开对相关性分析和回归模型的详细论述。

一、相关性分析相关性分析是用来研究两个或多个变量之间的相关关系,它主要通过计算相关系数来度量变量之间的相关性强度。

相关系数的范围在-1到1之间,0表示两个变量之间无关,正数表示正相关,负数表示负相关。

我们可以通过相关性分析来探索变量之间的线性关系,并根据相关系数的大小来判断关系强度。

二、简单线性回归模型简单线性回归模型用于研究两个变量之间的线性关系。

通过拟合一条直线来描述自变量和因变量之间的关系,并通过回归方程来表示。

回归方程中的斜率表示两个变量之间的变化程度,截距表示当自变量为0时,因变量的取值。

我们可以使用简单线性回归模型来预测因变量的取值,并评估模型的拟合程度。

三、多元回归模型多元回归模型是在简单线性回归模型的基础上进行拓展的。

它可以研究多个自变量对因变量的影响,并通过回归方程进行建模。

多元回归模型可以更全面地理解各个变量对因变量的影响,并控制其他变量的影响。

在报告中,我们可以使用多元回归模型来解释变量之间的关系,并进行因果推断。

四、回归模型的评估回归模型的拟合程度可以使用各种指标来评估,如决定系数R-squared、均方差等。

决定系数表示模型能解释因变量变异的比例,越接近1表示模型拟合得越好。

均方差衡量预测值与实际值的离散程度,值越小表示预测得越准确。

在报告中,我们可以使用这些评估指标来判断回归模型的拟合程度和预测准确度。

五、多重共线性的检验多重共线性是指在多元回归模型中,自变量之间存在高度相关关系的情况。

多重共线性会导致回归模型估计量不准确,难以进行因果推断。

我们可以使用方差扩大因子来检验自变量之间的共线性程度,方差扩大因子越大表示共线性越严重。

在报告中,我们可以通过多重共线性的检验来评估回归模型的可靠性。

六、回归模型的应用回归模型在实际应用中有广泛的应用领域。

相关分析和回归分析的实践报告总结下载提示:该文档是本店铺精心编制而成的,希望大家下载后,能够帮助大家解决实际问题。

文档下载后可定制修改,请根据实际需要进行调整和使用,谢谢!本店铺为大家提供各种类型的实用资料,如教育随笔、日记赏析、句子摘抄、古诗大全、经典美文、话题作文、工作总结、词语解析、文案摘录、其他资料等等,想了解不同资料格式和写法,敬请关注!Download tips: This document is carefully compiled by this editor. I hope that after you download it, it can help you solve practical problems. The document can be customized and modified after downloading, please adjust and use it according to actual needs, thank you! In addition, this shop provides you with various types of practical materials, such as educational essays, diary appreciation, sentence excerpts, ancient poems, classic articles, topic composition, work summary, word parsing, copy excerpts, other materials and so on, want to know different data formats and writing methods, please pay attention!一、简介相关分析和回归分析是统计学中常用的两种数据分析方法,通过对样本数据进行分析,可以揭示变量之间的关系和影响。

相关分析和回归分析的区别:1, 在相关分析中,解释变量X与被解释变量Y之间处于平等的位置。

而回归分析中,解释变量与被解释变量必须是严格确定的。

2 相关分析中,被解释变量Y与解释变量X全是随机变量。

而回归,被解释变量Y是随机的,解释变量X可能是随机的,可能是非随机的确定变量。

3 相关的研究主要主要是为刻画两变量间线性相关的密切程度。

而回归不仅可以揭示解释变量X和被解释变量Y的具体影响形式,而且还可以由回归方程进行预测和控制。

如果两变量间互为因果关系,解释变量与被解释变量互换位置,相关分析结果一样,回归分析结果不同。

样本回归函数与总体回归函数的区别: 1 总体是未知的,是客观唯一存在的。

样本是根据样本数据拟合的,每抽取一个样本,变可以拟合一条样本回归线。

2 总体中的β0和β1是未知参数,表现为常数。

而样本中的是随机变量,其具体数值随样本观测值的不同而变化。

3 随机误差ui 是实际Yi值与总体函数均值E(Yi)的离差,即Yi与总体回归线的纵向距离,是不可直接观测的。

而样本的残差ei是yi与样本回归线的纵向距离,当拟合了样本回归后,可以计算出ei的具体数值。

一元的五个基本假定:1 随机扰动项ui的均值为零,即E(ui)=02 随机扰动项ui的方差为常数Var(ui)=E[ui-E(ui)]^2=E(ui^2)=σ^23 任意两个随机扰动项ui和uj互不(i不等于j)互不相关,其其协方差为0Cov(ui,uj)=04 随机扰动项ui与解释变量Xi线性无关Cov(ui,Xi)=05 随机扰动项服从正态分布,即ui~N(0,σ^2)样本分段比较法适用于检验样本容量较大的线性回归模型可能存在的递增或递减型的异方差性,思路是首先量样本按某个解释变量从大到小或小到大顺序排列,并将样本均匀分成两段,有时为增强显著性,可去掉中间占样本单位1/4或1/3的部分单位;然后就各段分别用普通最小二乘法拟合回归直线,并计算各自的残差平方和,大的用RSS1,小的用RSS2表示,如果数值之比明显大于1,则存在异方差异方差性的后果:1 参数估计值虽然是无偏的,但却不是有效的。

谈一谈相关性分析和回归分析

相关性分析和回归分析都是一种对某种特定变量之间的关联性以及它们之间的变化趋势进行研究的技术。

它们的主要用途在于发现两个或多个变量之间的关系,进而为我们更深入地了解其产生的原因提供理论支持,甚至可以倾斜这种关系来影响和预测特定结果。

首先,相关性分析用于检查不同变量之间的线性关系,以检测两个变量之间的关系是否相关,以及这种相关性的强弱程度。

它的研究范围可以扩展到多个变量,这就是所谓的多重相关性。

相关性分析为研究者提供了一种简单而有效的方法来识别多个变量之间的关联,以便提供直观的洞察力。

而回归分析对相关性分析来说又稍微有些不同,它旨在建立一种线性模型,以探索变量之间存在的动态关系。

这种模型可以帮助我们研究多变量之间的联系,并根据它们之间的变化趋势来预测下一次变化可能出现的值。

当已知两个变量之间的关系时,回归分析可以让研究者实证地预测其中一个变量对另一个变量的影响。

因此,总的来说,相关性分析和回归分析可以在研究者的帮助下识别特定变量之间的线性关系,并研究它们之间变化的趋势,从而推断出影响这些变量的原因和结果,最终用以影响整个研究的结果。

数据的相关性与回归分析数据的相关性与回归分析是统计学中重要的概念和方法,用于探究变量之间的关系以及预测未知变量的值。

在本文中,我们将介绍相关性和回归分析的基本概念和原理,并探讨其在实际问题中的应用。

一、相关性的概念与计算相关性是用来衡量两个变量之间关系的强度和方向的指标。

一般来说,相关性的取值范围在-1到1之间,-1表示完全负相关,1表示完全正相关,0表示无相关关系。

计算相关性的常用方法是皮尔逊相关系数(Pearson correlation coefficient)。

皮尔逊相关系数可以通过下面的公式计算得到:r = (Σ[(xi - ȳ)(yi - ȳ)]) / (sqrt(Σ(xi - ȳ)²) * sqrt(Σ(yi - ȳ)²))其中,r表示相关系数,xi与yi分别表示第i个观测值的两个变量的取值,ȳ表示所有yi的均值。

二、回归分析的基本原理回归分析是一种建立变量之间关系模型的方法,它可以通过已知数据来预测未知变量的值。

回归分析的基本原理是建立一个方程来描述自变量和因变量之间的关系,通过该方程来进行预测或推断。

在回归分析中,通常假设自变量和因变量之间服从线性关系。

简单线性回归是其中最基本的形式,它的方程可以表示为:y = β0 + β1x + ε其中,y表示因变量的值,x表示自变量的值,β0和β1表示回归系数,ε表示误差项。

三、回归模型的建立和评估为了建立回归模型,我们需要有足够的数据来拟合该模型,并进行评估。

常用的评估指标有均方误差(Mean Squared Error)和确定系数(Coefficient of Determination)等。

均方误差可以通过下面的公式计算得到:MSE = Σ(yi - ŷi)² / n其中,yi表示观测值的实际值,ŷi表示回归模型预测的值,n表示观测值的个数。

确定系数可以通过下面的公式计算得到:R² = 1 - (Σ(yi - ŷi)² / Σ(yi - ȳ)²)其中,ȳ表示观测值的平均值。