Matlab人工神经网络工具箱中的BP工具函数及其应用

- 格式:pdf

- 大小:179.59 KB

- 文档页数:4

BP神经网络原理及其MATLAB应用BP神经网络(Back Propagation Neural Network)是一种基于梯度下降算法的人工神经网络模型,具有较广泛的应用。

它具有模拟人类神经系统的记忆能力和学习能力,可以用来解决函数逼近、分类和模式识别等问题。

本文将介绍BP神经网络的原理及其在MATLAB中的应用。

BP神经网络的原理基于神经元间的权值和偏置进行计算。

一个标准的BP神经网络通常包含三层:输入层、隐藏层和输出层。

输入层负责接收输入信息,其节点数与输入维度相同;隐藏层用于提取输入信息的特征,其节点数可以根据具体问题进行设定;输出层负责输出最终的结果,其节点数根据问题的要求决定。

BP神经网络的训练过程可以分为前向传播和反向传播两个阶段。

前向传播过程中,输入信息逐层传递至输出层,通过对神经元的激活函数进行计算,得到神经网络的输出值。

反向传播过程中,通过最小化损失函数的梯度下降算法,不断调整神经元间的权值和偏置,以减小网络输出与实际输出之间的误差,达到训练网络的目的。

在MATLAB中,可以使用Neural Network Toolbox工具箱来实现BP神经网络。

以下是BP神经网络在MATLAB中的应用示例:首先,需导入BP神经网络所需的样本数据。

可以使用MATLAB中的load函数读取数据文件,并将其分为训练集和测试集:```data = load('dataset.mat');inputs = data(:, 1:end-1);targets = data(:, end);[trainInd, valInd, testInd] = dividerand(size(inputs, 1), 0.6, 0.2, 0.2);trainInputs = inputs(trainInd, :);trainTargets = targets(trainInd, :);valInputs = inputs(valInd, :);valTargets = targets(valInd, :);testInputs = inputs(testInd, :);testTargets = targets(testInd, :);```接下来,可以使用MATLAB的feedforwardnet函数构建BP神经网络模型,并进行网络训练和测试:```hiddenLayerSize = 10;net = feedforwardnet(hiddenLayerSize);net = train(net, trainInputs', trainTargets');outputs = net(testInputs');```最后,可以使用MATLAB提供的performance函数计算网络的性能指标,如均方误差、相关系数等:```performance = perform(net, testTargets', outputs);```通过逐步调整网络模型的参数和拓扑结构,如隐藏层节点数、学习率等,可以进一步优化BP神经网络的性能。

Matlab工具箱中的BP与RBF函数Matlab神经网络工具箱中的函数非常丰富,给网络设置合适的属性,可以加快网络的学习速度,缩短网络的学习进程。

限于篇幅,仅对本章所用到的函数进行介绍,其它的函数及其用法请读者参考联机文档和帮助。

1 BP与RBF网络创建函数在Matlab工具箱中有如表1所示的创建网络的函数,作为示例,这里只介绍函数newff、newcf、newrb和newrbe。

表 1 神经网络创建函数(1) newff函数功能:创建一个前馈BP神经网络。

调用格式:net = newff(PR,[S1 S2...S Nl],{TF1 TF2...TF Nl},BTF,BLF,PF) 参数说明:•PR - R个输入的最小、最大值构成的R×2矩阵;•S i–S NI层网络第i层的神经元个数;•TF i - 第i层的传递函数,可以是任意可导函数,默认为'tansig',可设置为logsig,purelin等;•BTF -反向传播网络训练函数,默认为'trainlm',可设置为trainbfg,trainrp,traingd等;•BLF -反向传播权值、阈值学习函数,默认为'learngdm';•PF -功能函数,默认为'mse';(2) newcf函数功能:创建一个N层的层叠(cascade)BP网络调用格式:net = newcf(Pr,[S1 S2...SNl],{TF1 TF2...TFNl},BTF,BLF,PF) 参数同函数newff。

(3) newrb函数功能:创建一个径向基神经网络。

径向基网络可以用来对一个函数进行逼近。

newrb函数用来创建一个径向基网络,它可以是两参数网络,也可以是四参数网络。

在网络的隐层添加神经元,直到网络满足指定的均方误差要求。

调用格式:net = newrb(P,T,GOAL,SPREAD)参数说明:•P:Q个输入向量构成的R×Q矩阵;•T:Q个期望输出向量构成的S×Q矩阵;•GOAL:均方误差要求,默认为0。

作者简介:闵惜琳(1974-),女,助教,硕士,主要研究方向:管理信息系统、决策支持系统; 刘国华(1974-),男,博士研究生,主要研究方向:人工智能、计算机辅助材料设计.文章编号:1001-9081(2001)08-0163-02用MATLAB 神经网络工具箱开发BP 网络应用闵惜琳1,刘国华2(1.广东工业大学,广东广州510090; 2.北京科技大学理化系,北京100083)摘 要:论述了人工神经网络的基本理论,并给出利用MATLAB 神经网络工具箱开发BP 网络应用的要点。

关键词:MATLAB;人工神经网络(ANN);工具箱中图分类号:TP311.52 文献标识码:A人工神经网络(Artificial Neural Networks,ANN )是近年来发展起来的模拟人脑生物过程的人工智能技术。

它由大量的、同时也是很简单的处理单元(神经元)广泛互连形成的复杂的非线性系统[1]。

它不需要任何先验公式,就能从已有数据中自动地归纳规则,获得这些数据的内在规律,具有很强的非线性映射能力,特别适合于因果关系复杂的非确性推理、判断、识别和分类等问题。

人工神经网络可通过硬件或软件方式来实现。

硬件方式即神经计算机。

目前较常用的还是软件实现方式。

已有许多公司和研究单位设计了通用的AAN 程序以方便人们使用,MATLAB 提供的神经网络工具箱就是其重要代表。

MATLAB 是由MathWorks 公司推出的高性能的科技应用软件,在学术界和工业界都得到了广泛的应用。

与Basic 、Fortran 、Pascal 和C 等编程语言相比,MATLAB 具有程序可读性强、调试简单等特点,尤其是在编写含矩阵运算的复杂程序时,能给用户提供极大的方便[2]。

MATLAB 之所以功能强大是因为它提供了许多工具箱,其中神经网络工具箱是以人工神经网络理论为基础,用MATLAB 语言构造出了该理论所涉及的公式运算、矩阵操作和方程求解等大部分子程序,以用于神经网络设计和训练。

基于MATLAB神经网络工具箱的BP网络设计摘要本文介绍了MA TLAB神经网络工具箱及其常用的工具箱函数;在说明BP网络的模型结构和算法的基础上,讨论了BP网络的训练过程及其设计原则,并用一个典型的两层结构的神经网络实现了具有函数逼近功能的BP网络设计。

关键词: MAT LAB神经网络工具箱BP算法BP网络设计函数逼近Abstract Firstly, the MATLAB’s Neural Net works Toolbox and its common toolbox functions are presen2ted . Then, after the model structure and arithmetic of the BP Neural Net work being introduced briefly, its training process and the design principle are analyzed emphatically . At last, with the help of the MATLAB Neural Net work Toolbox, the design of a typical two - layer - structure BP Neural Net work of function approaching is implemented Keywords MAT LAB neural net works toolbox BP arithmetic BP neural net works design Function approaching引言神经网络理论是在20世纪提出的,它从微观结构和功能上模拟人脑的组织机构和运行机制,能够较好地描述非线性系统和不确定系统。

由于神经网络具有可并行计算、分布式信息存储、自适应和学习能力强等优点,在很多领域获得了极其广泛的应用。

(整理)BP神经网络matlab实现和matlab工具箱使用实例.BP神经网络matlab实现和matlab工具箱使用实例经过最近一段时间的神经网络学习,终于能初步使用matlab实现BP网络仿真试验。

这里特别感谢研友sistor2004的帖子《自己编的BP算法(工具:matlab)》和研友wangleisxcc的帖子《用C++,Matlab,Fortran实现的BP算法》前者帮助我对BP算法有了更明确的认识,后者让我对matlab下BP函数的使用有了初步了解。

因为他们发的帖子都没有加注释,对我等新手阅读时有一定困难,所以我把sistor2004发的程序稍加修改后加注了详细解释,方便新手阅读。

%严格按照BP网络计算公式来设计的一个matlab程序,对BP网络进行了优化设计%yyy,即在o(k)计算公式时,当网络进入平坦区时(<0.0001)学习率加大,出来后学习率又还原%v(i,j)=v(i,j)+deltv(i,j)+a*dv(i,j); 动量项clear allclcinputNums=3; %输入层节点outputNums=3; %输出层节点hideNums=10; %隐层节点数maxcount=20000; %最大迭代次数samplenum=3; %一个计数器,无意义precision=0.001; %预设精度yyy=1.3; %yyy是帮助网络加速走出平坦区alpha=0.01; %学习率设定值a=0.5; %BP优化算法的一个设定值,对上组训练的调整值按比例修改字串9error=zeros(1,maxcount+1); %error数组初始化;目的是预分配内存空间errorp=zeros(1,samplenum); %同上v=rand(inputNums,hideNums); %3*10;v初始化为一个3*10的随机归一矩阵; v表输入层到隐层的权值deltv=zeros(inputNums,hideNums); %3*10;内存空间预分配dv=zeros(inputNums,hideNums); %3*10;w=rand(hideNums,outputNums); %10*3;同Vdeltw=zeros(hideNums,outputNums);%10*3dw=zeros(hideNums,outputNums); %10*3samplelist=[0.1323,0.323,-0.132;0.321,0.2434,0.456;-0.6546,-0.3242,0.3255]; %3*3;指定输入值3*3(实为3个向量)expectlist=[0.5435,0.422,-0.642;0.1,0.562,0.5675;-0.6464,-0.756,0.11]; %3*3;期望输出值3*3(实为3个向量),有导师的监督学习count=1;while (count<=maxcount) %结束条件1迭代20000次c=1;while (c<=samplenum)for k=1:outputNumsd(k)=expectlist(c,k); %获得期望输出的向量,d(1:3)表示一个期望向量内的值endfor i=1:inputNumsx(i)=samplelist(c,i); %获得输入的向量(数据),x(1:3)表一个训练向量字串4end%Forward();for j=1:hideNumsnet=0.0;for i=1:inputNumsnet=net+x(i)*v(i,j);%输入层到隐层的加权和∑X(i)V(i)endy(j)=1/(1+exp(-net)); %输出层处理f(x)=1/(1+exp(-x))单极性sigmiod函数endfor k=1:outputNumsnet=0.0;for j=1:hideNumsnet=net+y(j)*w(j,k);endif count>=2&&error(count)-error(count+1)<=0.0001o(k)=1/(1+exp(-net)/yyy); %平坦区加大学习率else o(k)=1/(1+exp(-net)); %同上endend%BpError(c)反馈/修改;errortmp=0.0;for k=1:outputNumserrortmp=errortmp+(d(k)-o(k))^2; %第一组训练后的误差计算enderrorp(c)=0.5*errortmp; %误差E=∑(d(k)-o(k))^2 * 1/2%end%Backward();for k=1:outputNumsyitao(k)=(d(k)-o(k))*o(k)*(1-o(k)); %输入层误差偏导字串5endfor j=1:hideNumstem=0.0;for k=1:outputNumstem=tem+yitao(k)*w(j,k); %为了求隐层偏导,而计算的∑endyitay(j)=tem*y(j)*(1-y(j)); %隐层偏导end%调整各层权值for j=1:hideNumsfor k=1:outputNumsdeltw(j,k)=alpha*yitao(k)*y(j); %权值w的调整量deltw(已乘学习率)w(j,k)=w(j,k)+deltw(j,k)+a*dw(j,k);%权值调整,这里的dw=dletw(t-1),实际是对BP算法的一个dw(j,k)=deltw(j,k); %改进措施--增加动量项目的是提高训练速度endendfor i=1:inputNumsfor j=1:hideNumsdeltv(i,j)=alpha*yitay(j)*x(i); %同上deltwv(i,j)=v(i,j)+deltv(i,j)+a*dv(i,j);dv(i,j)=deltv(i,j);endendc=c+1;end%第二个while结束;表示一次BP训练结束double tmp;tmp=0.0; 字串8for i=1:samplenumtmp=tmp+errorp(i)*errorp(i);%误差求和endtmp=tmp/c;error(count)=sqrt(tmp);%误差求均方根,即精度if (error(count)<precision)%另一个结束条件< p="">break;endcount=count+1;%训练次数加1end%第一个while结束error(maxcount+1)=error(maxcount);p=1:count;pp=p/50;plot(pp,error(p),"-"); %显示误差然后下面是研友wangleisxcc的程序基础上,我把初始化网络,训练网络,和网络使用三个稍微集成后的一个新函数bpnet %简单的BP神经网络集成,使用时直接调用bpnet就行%输入的是p-作为训练值的输入% t-也是网络的期望输出结果% ynum-设定隐层点数一般取3~20;% maxnum-如果训练一直达不到期望误差之内,那么BP迭代的次数一般设为5000% ex-期望误差,也就是训练一小于这个误差后结束迭代一般设为0.01% lr-学习率一般设为0.01% pp-使用p-t虚拟蓝好的BP网络来分类计算的向量,也就是嵌入二值水印的大组系数进行训练然后得到二值序列% ww-输出结果% 注明:ynum,maxnum,ex,lr均是一个值;而p,t,pp,ww均可以为向量字串1% 比如p是m*n的n维行向量,t那么为m*k的k维行向量,pp为o*i的i维行向量,ww为o* k的k维行向量%p,t作为网络训练输入,pp作为训练好的网络输入计算,最后的ww作为pp经过训练好的BP训练后的输出function ww=bpnet(p,t,ynum,maxnum,ex,lr,pp)plot(p,t,"+");title("训练向量");xlabel("P");ylabel("t");[w1,b1,w2,b2]=initff(p,ynum,"tansig",t,"purelin"); %初始化含一个隐层的BP网络zhen=25; %每迭代多少次更新显示biglr=1.1; %学习慢时学习率(用于跳出平坦区)litlr=0.7; %学习快时学习率(梯度下降过快时)a=0.7 %动量项a大小(△W(t)=lr*X*ん+a*△W(t-1))tp=[zhen maxnum ex lr biglr litlr a 1.04]; %trainbpx[w1,b1,w2,b2,ep,tr]=trainbpx(w1,b1,"tansig",w2,b2,"purelin", p,t,tp);ww=simuff(pp,w1,b1,"tansig",w2,b2,"purelin"); %ww就是调用结果下面是bpnet使用简例:%bpnet举例,因为BP网络的权值初始化都是随即生成,所以每次运行的状态可能不一样。

Matlab的BP神经⽹络⼯具箱及其在函数逼近中的应⽤1.神经⽹络⼯具箱概述Matlab神经⽹络⼯具箱⼏乎包含了现有神经⽹络的最新成果,神经⽹络⼯具箱模型包括感知器、线性⽹络、BP⽹络、径向基函数⽹络、竞争型神经⽹络、⾃组织⽹络和学习向量量化⽹络、反馈⽹络。

本⽂只介绍BP神经⽹络⼯具箱。

2.BP神经⽹络⼯具箱介绍BP神经⽹络学习规则是不断地调整神经⽹络的权值和偏值,使得⽹络输出的均⽅误差和最⼩。

下⾯是关于⼀些BP神经⽹络的创建和训练的名称:(1)newff:创建⼀前馈BP⽹络(隐含层只有⼀层)(2)newcf:创建⼀多层前馈BP⽹络(隐含层有多层)(3)train:训练⼀个神经⽹络(4)sim:仿真⼀个神经⽹络以上⼏个是最主要的语句,在后⾯的实例应⽤中会详细说明⽤法。

3.BP神经⽹络⼯具箱在函数逼近中的应⽤BP神经⽹络具有很强的映射能⼒,主要⽤于模式识别分类、函数逼近、函数压缩等。

下⾯通过实例来说明BP⽹络在函数逼近⽅⾯的应⽤。

本⽂需要逼近的函数是f(x)=1+sin(k*pi/2*x),其中,选择k=2进⾏仿真,设置隐藏层神经元数⽬为n,n可以改变,便于后⾯观察隐藏层节点与函数逼近能⼒的关系。

3.1 k=2,n=5时的仿真实验先作出⽬标曲线的图形,以下为matlab代码:clear allclc%%%%%%%%%%设置⽹络输⼊值和⽬标值%%%%%%%%%%k=2;%f(x)中的k值x=[-1:.05:8];f=1+sin(k*pi/2*x);plot(x,f,'-');title('要逼近的⾮线性函数');xlabel('时间');ylabel('⾮线性函数');接着⽤newff函数建⽴BP神经⽹络结构,以下为matlab代码:%%%%%%%%%%建⽴⽹络%%%%%%%%%%n=5;%隐藏层节点数net = newff(minmax(x),[n,1],{'tansig' 'purelin'},'trainlm');%对于初始⽹络,可以应⽤sim()函数观察⽹络输出。

目录1绪论 (1)1.1人工神经网络的研究背景和意义 (1)1.2神经网络的发展与研究现状 (2)1.3神经网络的研究内容和目前存在的问题 (3)1.4神经网络的应用 (4)2神经网络结构及BP神经网络 (4)2.1神经元与网络结构 (4)2.2BP神经网络及其原理 (7)2.3BP神经网络的主要功能 (9)2.4BP网络的优点以及局限性 (9)3BP神经网络在实例中的应用 (10)3.1基于MATLAB的BP神经网络工具箱函数 (10)3.2BP网络在函数逼近中的应用 (12)3.3BP网络在样本含量估计中的应用 (17)4结束语 (23)参考文献: (24)英文摘要 (25)致谢 (26)基于MATLAB的BP神经网络应用1绪论人工神经网络(Artificial Neural Networks,NN)是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的许多基本特征,是一个高度复杂的非线性动力学系统[1]。

神经网络具有大规模并行、分布式存储和处理、自组织、自适应和自学习能力,特别适合处理需要同时考虑许多因素和条件的、不精确和模糊的信息处理问题。

神经网络的发展与神经科学、数理科学、认知科学、计算机科学、人工智能、信息科学、控制论、机器人学、微电子学、心理学、微电子学、心理学、光计算、分子生物学等有关,是一门新兴的边缘交叉学科。

神经网络具有非线性自适应的信息处理能力,克服了传统人工智能方法对于直觉的缺陷,因而在神经专家系统、模式识别、智能控制、组合优化、预测等领域得到成功应用[2]。

神经网络与其他传统方法相组合,将推动人工智能和信息处理技术不断发展。

近年来,神经网络在模拟人类认知的道路上更加深入发展,并与模糊系统、遗传算法、进化机制等组合,形成计算智能,成为人工智能的一个重要方向。

MATLAB是一种科学与工程计算的高级语言,广泛地运用于包括信号与图像处理,控制系统设计,系统仿真等诸多领域。

智能控制MALAB神经网络BP算法智能控制MALAB神经网络BP算法是一种基于MATLAB平台的智能控制算法,用于神经网络的训练和优化。

BP算法,即反向传播算法,是一种常用的神经网络训练算法,通过不断调整网络权值和阈值,使得网络的输出与期望输出之间的误差最小化。

在MATLAB中,可以利用自带的神经网络工具箱来实现BP算法。

具体步骤如下:一、数据准备数据准备是智能控制MALAB神经网络BP算法的第一步,它涉及到准备训练数据集和测试数据集。

以下是数据准备的详细步骤:1.收集和整理数据:首先,需要收集与问题相关的数据,并将其整理成适合神经网络输入的格式。

数据可以来自实验、观测、模拟等途径。

2.数据预处理:对收集到的原始数据进行预处理,以便更好地适应神经网络的训练和优化。

预处理步骤可能包括数据清洗、去噪、归一化、标准化等。

这些步骤有助于提高数据的质量和可靠性。

3.数据划分:将整个数据集划分为训练数据集和测试数据集。

通常,大部分数据用于训练神经网络,而少部分数据用于测试网络的泛化能力。

常见的划分方法包括随机划分、交叉验证等。

4.数据编码:对于非数值型数据,需要进行编码转换成数值型数据。

例如,可以使用独热编码将分类变量转换为二进制向量。

5.数据特征选择:根据问题的需求和特征的相关性,选择合适的特征子集。

这有助于减少数据维度,提高训练效率和模型性能。

6.数据平衡:对于不平衡的数据集,可以采取一些方法来平衡正负样本的比例,例如过采样、欠采样、SMOTE等。

数据准备是神经网络训练的重要环节,对于获得良好的训练结果和模型性能至关重要。

通过合理的数据准备步骤,可以提高神经网络的训练效率和泛化能力,从而实现智能控制任务的优化。

二、网络创建使用MATLAB的神经网络工具箱,可以创建一个BP神经网络模型。

可以选择网络的拓扑结构,包括输入层、隐藏层和输出层的节点数目,以及激活函数等参数。

以下是网络创建的详细步骤:1.确定网络的拓扑结构:首先,需要确定网络的拓扑结构,包括输入层、隐藏层和输出层的节点数目。

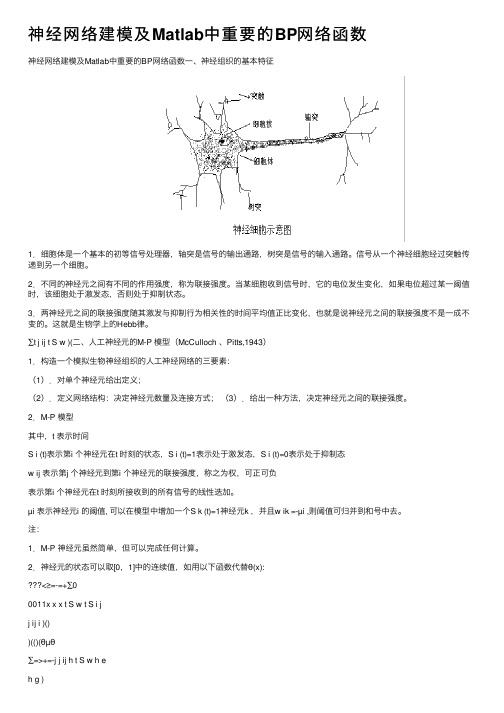

神经⽹络建模及Matlab中重要的BP⽹络函数神经⽹络建模及Matlab中重要的BP⽹络函数⼀、神经组织的基本特征1.细胞体是⼀个基本的初等信号处理器,轴突是信号的输出通路,树突是信号的输⼊通路。

信号从⼀个神经细胞经过突触传递到另⼀个细胞。

2.不同的神经元之间有不同的作⽤强度,称为联接强度。

当某细胞收到信号时,它的电位发⽣变化,如果电位超过某⼀阈值时,该细胞处于激发态,否则处于抑制状态。

3.两神经元之间的联接强度随其激发与抑制⾏为相关性的时间平均值正⽐变化,也就是说神经元之间的联接强度不是⼀成不变的。

这就是⽣物学上的Hebb律。

∑t j ij t S w )(⼆、⼈⼯神经元的M-P 模型(McCulloch 、Pitts,1943)1.构造⼀个模拟⽣物神经组织的⼈⼯神经⽹络的三要素:(1).对单个神经元给出定义;(2).定义⽹络结构:决定神经元数量及连接⽅式;(3).给出⼀种⽅法,决定神经元之间的联接强度。

2.M-P 模型其中,t 表⽰时间S i (t)表⽰第i 个神经元在t 时刻的状态,S i (t)=1表⽰处于激发态,S i (t)=0表⽰处于抑制态w ij 表⽰第j 个神经元到第i 个神经元的联接强度,称之为权,可正可负表⽰第i 个神经元在t 时刻所接收到的所有信号的线性迭加。

µi 表⽰神经元i 的阈值, 可以在模型中增加⼀个S k (t)=1神经元k ,并且w ik =-µi ,则阈值可归并到和号中去。

注:1.M-P 神经元虽然简单,但可以完成任何计算。

2.神经元的状态可以取[0,1]中的连续值,如⽤以下函数代替θ(x):<≥=-=+∑00011x x x t S w t S i jj ij i )())(()(θµθ∑=>+=-j j ij h t S w h eh g )()(0 11 2ββ三、多层前传⽹络1.特点:相邻层全互连同层没有连接输出与输⼊没有直接联系2.各层神经元个数的确定输⼊层、输出层的神经元个数由研究对象的输⼊、输出信息来确定。

燕山大学模式识别与智能系统导论题目:BP网络在函数逼近中的应用专业:控制工程姓名: X X X学号:一BP神经网络及其原理............................................................ - 1 -1.1 BP神经网络定义............................................................. - 1 -1.2 BP神经网络模型及其基本原理..................................... - 1 -1.3 BP神经网络的主要功能................................................. - 3 -1.4 BP网络的优点以及局限性............................................. - 3 - 二基于MATLAB的BP神经网络工具箱函数 ........................ - 6 -2.1 BP网络创建函数............................................................. - 7 -2.2 神经元上的传递函数...................................................... - 7 -2.3 BP网络学习函数............................................................. - 8 -2.4 BP网络训练函数............................................................. - 9 - 三BP网络在函数逼近中的应用.............................................. - 10 -3.1 问题的提出.................................................................... - 10 -3.2 基于BP神经网络逼近函数......................................... - 10 -3.3 不同频率下的逼近效果................................................ - 14 -3.4 讨论................................................................................ - 17 -一BP神经网络及其原理1.1 BP神经网络定义BP (Back Propagation)神经网络是一种神经网络学习算法。

Matlab的神经网络工具箱有效指南夏寒发布时刻:2000/11/09文章摘要:第一章是神经网络的大体介绍,第二章包括了由工具箱指定的有关网络结构和符号的大体材料和成立神经网络的一些大体函数,例如new、init、adapt和train。

第三章以反向传播网络为例讲解了反向传播网络的原理和应用的大体进程。

Matlab的神经网络工具箱有效指南第一章介绍1.神经网络神经网络是单个并行处置元素的集合,咱们从生物学神经系统取得启发。

在自然界,网络功能要紧由神经节决定,咱们能够通过改变连接点的权重来训练神经网络完成特定的功能。

一样的神经网络都是可调剂的,或说可训练的,如此一个特定的输入即可取得要求的输出。

如以下图所示。

那个地址,网络依照输出和目标的比较而调整,直到网络输出和目标匹配。

作为典型,许多输入/目标对应的方式已被用在有监督模式中来训练神经网络。

神经网络已经在各个领域中应用,以实现各类复杂的功能。

这些领域包括:模式识别、鉴定、分类、语音、翻译和操纵系统。

现在神经网络能够用来解决常规运算机和人难以解决的问题。

咱们要紧通过那个工具箱来成立示范的神经网络系统,并应用到工程、金融和其他实际项目中去。

一样普遍利用有监督训练方式,可是也能够通过无监督的训练方式或直接设计取得其他的神经网络。

无监督网络能够被应用在数据组的分辨上。

一些线形网络和Hopfield网络是直接设计的。

总的来讲,有各类各样的设计和学习方式来增强用户的选择。

神经网络领域已经有50年的历史了,可是实际的应用却是在最近15年里,现在神经网络仍快速进展着。

因此,它显然不同与操纵系统和最优化系统领域,它们的术语、数学理论和设计进程都已牢固的成立和应用了好连年。

咱们没有把神经网络工具箱仅看做一个能正常运行的建好的处置轮廓。

咱们宁愿希望它能成为一个有效的工业、教育和研究工具,一个能够帮忙用户找到什么能够做什么不能做的工具,一个能够帮忙进展和拓宽神经网络领域的工具。