人工神经网络例题

- 格式:doc

- 大小:106.50 KB

- 文档页数:6

人工智能与神经网络考试试题一、选择题(每题 5 分,共 30 分)1、以下哪个不是人工智能的应用领域?()A 医疗诊断B 金融投资C 艺术创作D 传统手工制造业2、神经网络中的神经元通过什么方式进行连接?()A 随机连接B 全连接C 部分连接D 以上都不对3、在训练神经网络时,常用的优化算法是()A 随机梯度下降B 牛顿法C 二分法D 以上都是4、下列关于人工智能和神经网络的说法,错误的是()A 人工智能包括神经网络B 神经网络是实现人工智能的一种方法C 人工智能就是神经网络D 神经网络具有学习能力5、下面哪种激活函数常用于神经网络?()A 线性函数B 阶跃函数C Sigmoid 函数D 以上都是6、神经网络的层数越多,其性能一定越好吗?()A 一定B 不一定C 肯定不好D 以上都不对二、填空题(每题 5 分,共 30 分)1、人工智能的英文缩写是_____。

2、神经网络中的“学习”是指通过调整_____来优化模型性能。

3、常见的神经网络架构有_____、_____等。

4、训练神经网络时,为了防止过拟合,可以采用_____、_____等方法。

5、深度学习是基于_____的一种机器学习方法。

6、神经网络中的损失函数用于衡量_____与_____之间的差异。

三、简答题(每题 10 分,共 20 分)1、请简要说明人工智能和机器学习的关系。

答:人工智能是一个广泛的概念,旨在让计算机能够像人类一样思考和行动,实现智能的表现。

机器学习则是实现人工智能的重要手段之一。

机器学习专注于让计算机通过数据和算法进行学习,自动发现数据中的模式和规律,从而能够对新的数据进行预测和决策。

机器学习为人工智能提供了技术支持,使计算机能够从大量数据中获取知识和技能,不断提升智能水平。

可以说机器学习是人工智能的核心组成部分,但人工智能不仅仅局限于机器学习,还包括其他技术和方法,如知识表示、推理、规划等。

2、简述神经网络中反向传播算法的原理。

1.人工神经网络适合于解决哪些问题?试举例说明。

人工神经网络技术在处理对内部规律不甚了解,也不能用一组规则和方程等数学表达式描述的较为复杂的问题时具有一定的优越性,尤其对容错性有一定要求的任务,例如图形的检测与识别、诊断、特征提取、推论等,人工神经网络都是比较合适的处理手段,对于上述任务,即使输入数据是模糊的或不完善的,人工神经网络仍然能够对其进行处理。

示例略。

2.一个人工神经网络应用的开发要经过哪些阶段?明确需求、选取模型、设计神经网络节点、设计神经网络结构、设计神经网络训练算法、选择训练和测试样本、网络训练与测试、实现神经网络。

3.若要用神经网络实现对0~9十个数字字符的识别,应当如何选取适当的人工神经网络模型?参见表8-1,可以选择BP、Hopfield等神经网络模型。

4.若要实现一个简单的交通标志识别系统,应当如何选取适当的人工神经网络模型?参见表8-1,可以选择BP、Hopfield等神经网络模型。

5.若有一个私人医生,每天可接受10个预约病人的上门服务。

若要为该医生设计一条当天的巡诊路线,以使该医生的巡诊距离最短,应当如何选取适当的人工神经网络模型?这是一个优化问题,可以选择Hopfield神经网络。

6.试述对习题2、3、4中选取的人工神经网络模型进行设计开发的全过程。

略。

7.有如下几种模型,其特性如表8-4所示。

表8-4 人工神经网络模型的基本性能若要开发一个贷款评估人工神经网络,要求能够根据借贷申请人的月收入、生活费用支出、房租、水、电、交通费用支出及其他费用支出来实时地分析这一贷款申请是否合格。

如合格,则批准申请给予贷款,否则给予拒绝。

请从表8-4列出的人工神经网络模型中选择一个适合该贷款评估应用的模型,并阐明原因。

可根据输出类型(例如,此题是一个分类问题,而不是优化问题)、训练方法、要求的训练时间和执行时间等选取各项指标都符合具体需求的模型。

此题只是一个示例,让读者掌握如何选取适当的人工神经网络模型,具体选取过程略。

神经网络例题1. 简介1.1 背景信息1.2 目的和范围2. 概述在本文档中,我们将讨论领域中使用的神经网络模型,并提供一些实际应用案例。

该模板旨在帮助读者理解如何构建、训练和优化神经网络。

3. 前置知识与概念解释在阅读本文之前,请确保您对以下术语有基本了解: - 神经元:一个计算单元,接收输入并输出。

- 权重:连接不同层次或节点间传递信号时所赋予的权值。

4. 示例问题描述及数据集准备我们选择了一个分类问题作为示例来说明如何使用神经网络进行预测。

具体而言,在给定鸢尾花(Iris)数据集下,我们要根据萼片长度、宽度以及花瓣长度等特征来判断其品种是Setosa, Versicolor还是Virginica。

5 . 数据处理与特征选择这个步骤包括加载原始数据文件、清洗缺失值、标准化数值变量以及转换类别变量到数字表示形式等操作。

6. 神经网络模型构建6.1 模型选择:我们将使用多层感知器(Multilayer Perceptron)作为神经网络的基本架构。

6.2 构建输入和输出层:根据问题描述,确定输入特征数目以及输出类别数目。

6.3 隐藏层数量与节点设置: 根据实际需求,在隐藏层中添加适当数量的节点,并考虑避免过拟合等问题。

7 . 训练与优化在这一阶段,我们需要定义损失函数、选择梯度下降算法并进行超参数调整。

同时还要划分训练集和测试集,并对模型进行迭代训练直至收敛或达到最大迭代次数。

8 . 结果评估我们通过计算准确率、查全率、查准率等指标来评估所得结果,并可视化展示预测效果。

9 . 实例应用案例这里了其他领域常见的神经网络应用案例:- 图像识别- 自然语言处理10 . 总结11.参考文献12.致谢13.附件说明:相关数据文件请参见“data.csv”;代码实现详见GitHub:“”。

14.法律名词及注释:- 神经网络:一种模拟人脑神经元工作方式的计算模型。

- 多层感知器(Multilayer Perceptron):由多个输入、隐藏和输出层组成的前馈神经网络。

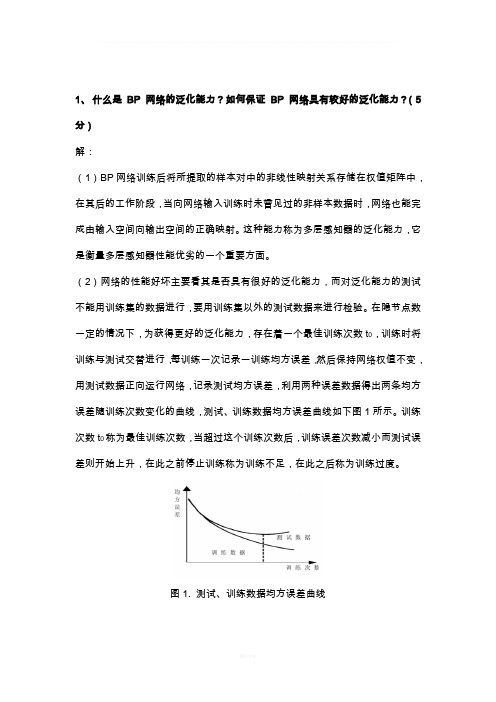

1、什么是BP 网络的泛化能力?如何保证BP 网络具有较好的泛化能力?(5分)解:(1)BP网络训练后将所提取的样本对中的非线性映射关系存储在权值矩阵中,在其后的工作阶段,当向网络输入训练时未曾见过的非样本数据时,网络也能完成由输入空间向输出空间的正确映射。

这种能力称为多层感知器的泛化能力,它是衡量多层感知器性能优劣的一个重要方面。

(2)网络的性能好坏主要看其是否具有很好的泛化能力,而对泛化能力的测试不能用训练集的数据进行,要用训练集以外的测试数据来进行检验。

在隐节点数一定的情况下,为获得更好的泛化能力,存在着一个最佳训练次数t0,训练时将训练与测试交替进行,每训练一次记录一训练均方误差,然后保持网络权值不变,用测试数据正向运行网络,记录测试均方误差,利用两种误差数据得出两条均方误差随训练次数变化的曲线,测试、训练数据均方误差曲线如下图1所示。

训练次数t0称为最佳训练次数,当超过这个训练次数后,训练误差次数减小而测试误差则开始上升,在此之前停止训练称为训练不足,在此之后称为训练过度。

图1. 测试、训练数据均方误差曲线2、什么是LVQ 网络?它与SOM 网络有什么区别和联系?(10 分)解:(1)学习向量量化(learning vector quantization,LVQ)网络是在竞争网络结构的基础上提出的,LVQ将竞争学习思想和监督学习算法相结合,减少计算量和储存量,其特点是网络的输出层采用监督学习算法而隐层采用竞争学习策略,结构是由输入层、竞争层、输出层组成。

(2)在LVQ网络学习过程中通过教师信号对输入样本的分配类别进行规定,从而克服了自组织网络采用无监督学习算法带来的缺乏分类信息的弱点。

自组织映射可以起到聚类的作用,但还不能直接分类和识别,因此这只是自适应解决模式分类问题中的第一步,第二步是学习向量量化,采用有监督方法,在训练中加入教师信号作为分类信息对权值进行细调,并对输出神经元预先指定其类别。

一、填空题1、人工神经网络是生理学上的真实人脑神经网络的结构和功能,以及若干基本特性的某种理论抽象、简化和模拟而构成的一种信息处理系统。

从系统的观点看,人工神经网络是由大量神经元通过及其丰富和完善的连接而构成的自适应非线性动态系统。

2、神经元(即神经细胞)是由细胞体、树突、轴突和突触四部分组成。

3、NN的特点:信息的分布存储、大规模并行协同处理、自学习、自组织、自适应性、NN大量神经元的集体行为。

4、膜电位:以外部电位作为参考电位的内部电位。

5、神经元的兴奋:产生膜电位约为100mv,时宽约为1ms,分为四个过程:输入信号期、兴奋期、绝对不应期、相对不应期。

6、神经元的动作特征:空间性相加、时间性相加、阀值作用、不应期、疲劳、可塑性。

7、阀值作用:膜电位上升不超过一定值55mv,神经元不兴奋。

8、学习形式按照输出y划分为:二分割学习、输出值学习、无教师学习。

9、权重改变方式:训练期的学习方式、模式学习方式。

10、稳定的平稳状态指当由于某些随机因素的干扰,使平衡状态发生偏移,随着时间的推移,偏移越来越小,系统最后回到平衡状态。

二、简答题1、学习规则可以分为那几类?答:(1)相关规则:仅根据连接间的激活水平改变权系;(2)纠错规则:基于或等效于梯度下降方法,通过在局部最大改善的方向上,按照小步逐次进行修正,力图达到表示函数功能问题的全局解;(3)无导师学习规则:学习表现为自适应与输入空间的检测规则。

2、简述神经网络按照不同标准分类。

答:按网络结构分为前馈型和反馈型;按网络的性能分为连续性和离散性、确定性和随机性网络;按照学习方式分为有导师(指导)和无导师(自组织学习包括在内)学习;按照突触连接性质分为一阶线性关联与高阶非线性关联网络。

3、误差反传算法的主要思想?答:误差反传算法把学习过程分为两个阶段:第一阶段(正向传播过程),给出输入信息通过输入层经隐含层逐层处理并计算每个单元的实际输出值;第二阶段(反向过程),若在输出层未能得到期望的输出值,则逐层递归的计算实际输出与期望输出之差值(即误差),以便根据此差调节权值。

人工神经网络单选练习题一、基本概念1. 下列关于人工神经网络的描述,正确的是:A. 人工神经网络是一种静态的计算模型B. 人工神经网络可以模拟人脑的神经元连接方式C. 人工神经网络只能处理线性问题D. 人工神经网络的学习过程是监督式的2. 下列哪种算法不属于人工神经网络?A. 感知机算法B. 支持向量机算法C. BP算法D. Hopfield网络3. 人工神经网络的基本组成单元是:A. 神经元B. 节点C. 权重D. 阈值二、前向传播与反向传播4. 在前向传播过程中,下列哪个参数是固定的?A. 输入值B. 权重C. 阈值D. 输出值5. 反向传播算法的主要目的是:A. 更新输入值B. 更新权重和阈值C. 计算输出值D. 初始化网络参数6. 下列关于BP算法的描述,错误的是:A. BP算法是一种监督学习算法B. BP算法可以用于多层前馈神经网络C. BP算法的目标是最小化输出误差D. BP算法只能用于解决分类问题三、激活函数7. 下列哪种激活函数是非线性的?A. 步进函数B. Sigmoid函数C. 线性函数D. 常数函数8. ReLU激活函数的优点不包括:A. 计算简单B. 避免梯度消失C. 提高训练速度D. 减少过拟合9. 下列哪种激活函数会出现梯度饱和现象?A. Sigmoid函数B. ReLU函数C. Tanh函数D. Leaky ReLU函数四、网络结构与优化10. 关于深层神经网络,下列描述正确的是:A. 深层神经网络一定比浅层神经网络效果好B. 深层神经网络更容易过拟合C. 深层神经网络可以减少参数数量D. 深层神经网络训练速度更快11. 下列哪种方法可以降低神经网络的过拟合?A. 增加训练数据B. 减少网络层数C. 增加网络参数D. 使用固定的学习率12. 关于卷积神经网络(CNN),下列描述错误的是:A. CNN具有局部感知能力B. CNN具有参数共享特点C. CNN可以用于图像识别D. CNN无法处理序列数据五、应用场景13. 下列哪种问题不适合使用人工神经网络解决?A. 图像识别B. 自然语言处理C. 股票预测D. 线性规划14. 下列哪个领域不属于人工神经网络的应用范畴?A. 医学诊断B. 金融预测C. 智能家居D. 数值计算15. 关于循环神经网络(RNN),下列描述正确的是:A. RNN无法处理长距离依赖问题B. RNN具有短期记忆能力C. RNN训练过程中容易出现梯度消失D. RNN只能处理序列长度相同的数据六、训练技巧与正则化16. 下列哪种方法可以用来防止神经网络训练过程中的过拟合?A. 提前停止B. 增加更多神经元C. 减少训练数据D. 使用更大的学习率17. 关于Dropout正则化,下列描述错误的是:A. Dropout可以减少神经网络中的参数数量B. Dropout在训练过程中随机丢弃一些神经元C. Dropout可以提高模型的泛化能力D. Dropout在测试阶段不使用18. L1正则化和L2正则化的主要区别是:A. L1正则化倾向于产生稀疏解,L2正则化倾向于产生平滑解B. L1正则化比L2正则化更容易计算C. L2正则化可以防止过拟合,L1正则化不能D. L1正则化适用于大规模数据集,L2正则化适用于小规模数据集七、优化算法19. 关于梯度下降法,下列描述正确的是:A. 梯度下降法一定会找到全局最小值B. 梯度下降法在鞍点处无法继续优化C. 梯度下降法包括批量梯度下降、随机梯度下降和小批量梯度下降D. 梯度下降法的学习率在整个训练过程中保持不变20. 下列哪种优化算法可以自动调整学习率?A. 随机梯度下降(SGD)B. Adam优化算法C. Momentum优化算法D. 牛顿法21. 关于Adam优化算法,下列描述错误的是:A. Adam结合了Momentum和RMSprop算法的优点B. Adam算法可以自动调整学习率C. Adam算法对每个参数都使用相同的学习率D. Adam算法在训练初期可能会不稳定八、损失函数22. 在分类问题中,下列哪种损失函数适用于二分类问题?A. 均方误差(MSE)B. 交叉熵损失函数C. Hinge损失函数D. 对数损失函数23. 关于均方误差(MSE)损失函数,下列描述错误的是:A. MSE适用于回归问题B. MSE对异常值敏感C. MSE的输出范围是[0, +∞)D. MSE损失函数的梯度在接近最小值时趋近于024. 下列哪种损失函数适用于多分类问题?A. 交叉熵损失函数B. Hinge损失函数C. 对数损失函数D. 均方误差(MSE)九、模型评估与超参数调优25. 下列哪种方法可以用来评估神经网络的性能?A. 训练误差B. 测试误差C. 学习率D. 隐层神经元数量26. 关于超参数,下列描述正确的是:A. 超参数是在模型训练过程中自动学习的B. 超参数的值通常由经验丰富的专家设定C. 超参数的调整对模型性能没有影响D. 超参数包括学习率、批量大小和损失函数27. 关于交叉验证,下列描述错误的是:A. 交叉验证可以减少过拟合的风险B. 交叉验证可以提高模型的泛化能力C. 交叉验证会降低模型的训练速度D. 交叉验证适用于小规模数据集十、发展趋势与挑战28. 下列哪种技术是近年来人工神经网络的一个重要发展方向?A. 深度学习B. 线性回归C. 决策树D. K最近邻29. 关于深度学习,下列描述错误的是:A. 深度学习需要大量标注数据B. 深度学习模型通常包含多层神经网络C. 深度学习可以处理复杂的非线性问题D. 深度学习不适用于小规模数据集30. 下列哪种现象是训练深度神经网络时可能遇到的挑战?A. 梯度消失B. 参数过多C. 数据不平衡D. 所有上述选项都是挑战答案一、基本概念1. B2. B二、前向传播与反向传播4. B5. B6. D三、激活函数7. B8. D9. A四、网络结构与优化10. B11. A12. D五、应用场景13. D14. D15. C六、训练技巧与正则化16. A17. A18. A七、优化算法19. C20. B八、损失函数22. B23. D24. A九、模型评估与超参数调优25. B26. B27. D十、发展趋势与挑战28. A29. D30. D。

习题2.1什么是感知机?感知机的基本结构是什么样的?解答:感知机是Frank Rosenblatt在1957年就职于Cornell航空实验室时发明的一种人工神经网络。

它可以被视为一种最简单形式的前馈人工神经网络,是一种二元线性分类器。

感知机结构:2.2单层感知机与多层感知机之间的差异是什么?请举例说明。

解答:单层感知机与多层感知机的区别:1. 单层感知机只有输入层和输出层,多层感知机在输入与输出层之间还有若干隐藏层;2. 单层感知机只能解决线性可分问题,多层感知机还可以解决非线性可分问题。

2.3证明定理:样本集线性可分的充分必要条件是正实例点集所构成的凸壳与负实例点集构成的凸壳互不相交.解答:首先给出凸壳与线性可分的定义凸壳定义1:设集合S⊂R n,是由R n中的k个点所组成的集合,即S={x1,x2,⋯,x k}。

定义S的凸壳为conv(S)为:conv(S)={x=∑λi x iki=1|∑λi=1,λi≥0,i=1,2,⋯,k ki=1}线性可分定义2:给定一个数据集T={(x1,y1),(x2,y2),⋯,(x n,y n)}其中x i∈X=R n , y i∈Y={+1,−1} , i=1,2,⋯,n ,如果存在在某个超平面S:w∙x+b=0能够将数据集的正实例点和负实例点完全正确地划分到超平面的两侧,即对所有的正例点即y i=+1的实例i,有w∙x+b>0,对所有负实例点即y i=−1的实例i,有w∙x+b<0,则称数据集T为线性可分数据集;否则,称数据集T线性不可分。

必要性:线性可分→凸壳不相交设数据集T中的正例点集为S+,S+的凸壳为conv(S+),负实例点集为S−,S−的凸壳为conv(S−),若T是线性可分的,则存在一个超平面:w ∙x +b =0能够将S +和S −完全分离。

假设对于所有的正例点x i ,有:w ∙x i +b =εi易知εi >0,i =1,2,⋯,|S +|。

1、简要说明误差反向传播的BP算法的基本原理,讨论BP基本算法的优缺点。

并采用BP神经网络进行模式识别。

设计一个BP网络对附图中的英文字母进行分类。

输入向量含16个分量,输出向量分别用[1,-1,-1]T,[-1,1,-1]T,[-1,-1,1]T代表字符A,I,O。

采用不同的学习算法(traingd,traingdm,traingdx,trainlm)进行比较。

并测试施加5%噪声与输入时的测试结果。

要求:给出matlab的源程序(可调用matlab NN工具箱),网络结构,初始权值,训练结果,测试结果。

2、简要说明误差反向传播的BP算法的基本原理,讨论BP基本算法的优缺点。

并采用BP神经网络设计实现一个9*9表。

采用不同的学习算法(traingd,traingdm,traingdx,trainlm)进行比较。

要求:给出matlab的源程序(可调用matlab NN工具箱),网络结构,初始权值,训练结果,测试结果。

(考虑将其中的数改为二进制)3、简要说明误差反向传播的BP算法的基本原理,讨论BP基本算法的优缺点。

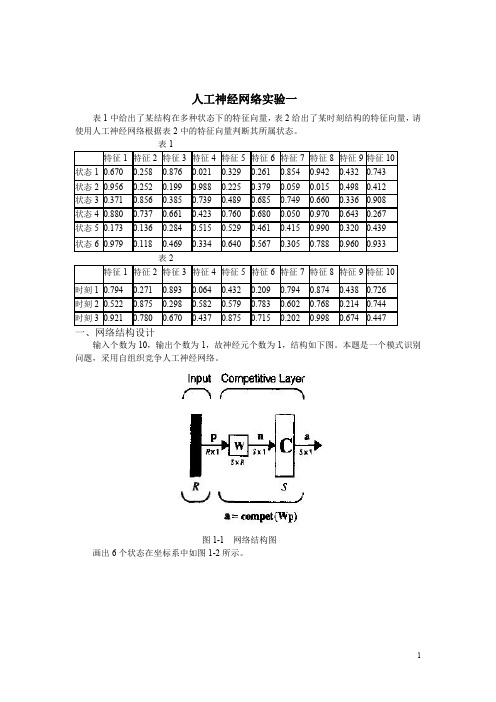

表1中给出了某结构在多种状态下的特征向量,表2给出了某时刻结构的特征向量,请使用人工神经网络根据表2中的特征向量判断其所属状态。

表1表2网络结构设计输入个数为10,输出个数为1,故神经元个数为1,结构如下图。

本题是一个模式识别问题,采用自组织竞争人工神经网络。

图1-1 网络结构图画出6个状态在坐标系中如图1-2所示。

%创建输入向量X=[0 1;0 1]clusters=6;points=10;std_dev=0.05;P=nngenc(X,clusters,points,std_dev);plot(P(1,:),P(2,:),'+r')title('Input Vectors');xlabel('p(1)');ylabel('p(2)');%创建自组织竞争神经网络net=newc([0 1;0 1],6,.1);net=init(net);w=net.IW{1};hold off;plot(P(1,:),P(2,:),'+r');hold on; plot(w(:,1),w(:,2),'ob');xlabel('p(1)');ylabel('p(2)');hold off;net.trainParam.epochs=7;hold on;net=init(net);more off;net=train(net,P);TRAINR, Epoch 0/7TRAINR, Epoch 7/7TRAINR, Maximum epoch reached. %训练该网络hold on ;net=init(net); more off;w=net.IW{1};delete(findobj(gcf,'color',[0 0 1])); hold offplot(P(1,:),P(2,:),'+r');hold off;hold on; plot(w(:,1),w(:,2),'ob'); xlabel('p(1)');ylabel('p(2)');hold off;%仿真该网络p=[0.794;0.271];a=sim(net,p);ac=vec2ind(a)。

1.非线性机器学习算法具有以下的什么特性?A.针对难以用准则来描述的复杂模型B.能够达到更深层次的抽象C.能够进行广泛使用的分类算法D.以上都是正确答案:D2.神经网络的学习步骤包括:1、求得权重等参数,2、定义代价函数,3、对测试数据进行预测,4、根据样本数据和标签采用梯度下降法进行学习,步骤的正确顺序为:A.4213B.2413C.2143D.4123正确答案:B二、判断题1.单层感知器能对线形可分的数据集进行分类,能解决逻辑问题异或。

正确答案:×2.前馈神经网络中偏置单元可以有输入。

正确答案:×3.在某种意思上,小批量梯度下降算法是以迭代次数换取算法的运行速度。

正确答案:√4.神经网络中的神经元有两个状态:兴奋、抑制。

这两个状态由阈值决定。

正确答案:√5.前馈式神经网络层间有反馈。

6.小批量梯度下降法在迭代的每一步中,参数的更新只用了小批量样本的信息。

正确答案:√7.小批量梯度下降法和随机梯度下降算法收敛可能需要更多的迭代次数正确答案:√三、多选题1.使用均方误差作为代价函数,有什么特点?( )A.形式简单B.通俗易懂C.容易出现饱和现象D.容易陷入局部最优解正确答案:A、B、C、D2.感知器可以解决一下哪些问题?( )A.实现逻辑关系中的与B.实现逻辑关系中的或C.实现逻辑关系中的非D.线性分类和线性回归问题正确答案:A、B、C、D3.神经网络具有下面哪几个特点?( )A.能充分逼近复杂的非线性关系B.具有高度的容错能力C.具有自组织能力D.可以并行分布处理正确答案:A、B、C、D4.以下会造成梯度消失的激活函数有( )。

A.sigmoid函数B.tanh函数C.ReLU函数D.softplus函数正确答案:A、B四、填空1.在()模型中,每个神经元同时将自身的输出作为输入信号反馈给其他神经元。

正确答案:反馈神经网络。

一、单项选择题1.人工神经网络是人工智能的三大流派思想中哪个流派的基础。

(B)A.符号主义B.连接主义(或称为仿生学派)C.行为主义D.逻辑推理主义2.以下关于感知器的说法错误的是(A)。

A.单层感知器可以解决异或问题B.感知器分类的原理是就是通过调整权重使两类不同的样本经过感知机模型后的输出不同C.单层感知器只能针对线性可分的数据集分类D.学习率可以控制每次权值调整力度3.人工神经网络的层数增加会出现梯度消失现象,其本质原因是(C)。

A.各层误差梯度相加导致B.各层误差梯度相减导致C.各层误差梯度相乘导致D.误差趋于饱和4.卷积层的主要作用是(A)A.提取图像特征B.降低输入维度C.解决梯度消失和梯度爆炸问题D.进行某种非线性变换二、多项选择题1.知识可以从以下哪几个维度来进行分类(AC)。

A.是否可统计B.是否可计算C.是否可推理D.是否可被人理解2.人工神经网络由许多神经元构成,M-P模型的主要特征包括(ABD)。

A.多输入单输出B.对输入加权求和C.具有树突和轴突D.具有激活函数3.卷积神经网络的结构主要包括(ABCD)。

A.卷积层B.池化层C.全连接层D.输入层三、判断题1.人工神经网络的层数是固定的,每层的神经元个数是不固定的(错)2.BP神经网络的误差是从前往后传播的(错)3.卷积神经网络的层数一般超过三层(对)四、简答题1.感知机是如何实现从数据中学习的?答:通过训练数据得到误差,再根据误差来调整权值,让再次计算训练数据得到的误差减小,最终达到无误差。

这时候得到的权值就称为学习到关于这些数据的知识。

2.什么是梯度,什么是梯度的方向?答:梯度就是把多元函数关于各个变量的偏导数放在一起构成的向量(也称为矢量)。

梯度方向表示当函数的各个变量都按照各自偏导数的比例进行增加时,各个增加量合起来构成的方向,是函数值变化最快的方向。

3.有A类物体和B类物体,均有两个类似的特征值。

以下有三个属于A类的样本,每个样本的特征值分别为[0.1, 1],[0.2, 0.7],[0.4, 0.8],样本标签用1表示;有三个属于B类的样本,其特征值分别为[0.8, 0.3],[0.9, 0.2],[1.0, 0.5],样本标签用0表示。

1.随机型神经网络的特点是什么?(1) 神经元的净输入不能决定其输出状态为0或1,决定神经元输出状态的是值为1或0的概率;(2) 在网络学习阶段,随机型神经网络并不基于某种确定性算法调整网络连接权值,而是按照某种概率分布进行处理;(3) 在网络运行阶段,随机型神经网络不是按照某种确定性的网络方程进行状态演变,而是按照某种概率分布决定网络状态的转移。

2.试述Boltzmann机的特点,并比较其与离散型Hopfield网络的异同。

从网络结构看,与离散型Hopfield神经网络相同的是,Boltzmann机网络为单层全互连结构,各个神经元之间采用双向对称连接方式,并且每个神经元到自身都无反馈;但与离散型Hopfield神经网络不同的是,Boltzmann机同时又考虑到了多层网络的特点,将神经元按照功能分为可视层与隐含层两大部分,其中的可视层又可以继续分为输入部分和输出部分,但是这些层次在Boltzmann机中并没有明显的划分界限。

从处理单元模型看,Boltzmann机网络的每个神经元的输出均为0、1二值离散输出,n 个神经元的状态集合构成了Boltzmann机网络的状态,即在给定时刻t,Boltzmann机网络的状态为X(t)=(x1, x2, …, x n),但与离散型Hopfield神经网络不同的是,Boltzmann机中的神经元不能通过其输入状态获得确定的输出状态,它的输出状态要由神经元净输入状态的概率决定,不同的净输入状态对应不同的输出状态概率。

从能量函数看,随着Boltzmann机的运行,从概率意义上说,网络的能量呈下降趋势。

这意味着在网络状态的演化过程中,尽管网络能量总的变化趋势是下降的,但不能排除在某一时刻某个神经元按照小概率事件进行状态变化,从而使网络的能量暂时上升;而随着离散型Hopfield神经网络的运行,王的能量是单调递减的。

3.为什么Boltzmann机可以避免陷入局部极小点?Boltzmann机的网络能量在概率意义上呈单调下降趋势,即在网络状态变化过程中,网络能量总的趋势是下降的,但也存在能量暂时上升的可能性,这种可能性使得Boltzmann机具有了跳出局部极小点的能力。

1图考虑如图所示的加权无向图,每一条边上的权值都代表了该链路的通信费用或者时间。

设l(i,j )是从结点i 到结点j 的链路长度,当i 和j 不直接相连时链路长度为+∞,并且设D (n )是从源结点到结点n 的最短通路长度,n ∈N 。

假定结点1为源结点,则:(1)初始化:置N ={1},对每一个v /∈N ,置D (v )=l (1,v )。

(2)重复:找出一个结点w /∈N ,且d (w )是最小的,把w 加入N 。

然后对所有不属于N 的结点v 按下式更新D (v )D (v )=Min [D (v ),D (v )+l (v,w )]计算过程如表所示。

步骤N D (2)D (3)D (4)D (5)D (6)初始化{1}251∞∞1{1,4}2412∞2{1,4,2}2412∞3{1,4,2,5}231244{1,4,2,5,3}231245{1,4,2,5,3,6}23124产生的最短通路树如图所示。

路由表如下。

目标结点转发结点22344454642感知器X 1 X 2 X i X N两输入感知器模型如下:ap 1p 2试用单个感知器神经元完成下列分类,写出其训练的迭代过程,画出最终的分类示意图。

已知:{X 1=[22],t 1=0};{X 2=[1−2],t 1=1};{X 3=[−22],t 1=0};{X 4=[−10],t 1=1};解:据题意,神经元有2个输入量,传输函数为阈值型函数。

于是以如图所示的感知器完成分类。

(1)初始化,W (0)=[00],b (0)=0(2)第1次迭代,a =f (n )=f (W (0)X 1+b (0))=f([00][22]+0)=f (0)=1e =t 1−a =0−1=−1因为输出不等于目标值,所以调整权值和阈值W (1)=W (0)+eX T1=[00]+(−1)[22]=[−2−2]b (1)=b (0)+e =0+(−1)=−1(3)第2次迭代。

神经网络学习假设w1(0)=0.2, w2(0)=0.4, θ(0)=0.3, η=0.4,请用单层感知器完成逻辑或运算的学习过程。

解:根据“或”运算的逻辑关系,可将问题转换为:输入向量:X1=[0, 0, 1, 1]X2=[0, 1, 0, 1]输出向量:Y=[0, 1, 1, 1]由题意可知,初始连接权值、阈值,以及增益因子的取值分别为:w1(0)=0.2, w2(0)=0.4, θ(0)=0.3,η=0.4即其输入向量X(0)和连接权值向量W(0)可分别表示为:X(0)=(-1, x1 (0), x2 (0))W(0)=(θ(0), w1(0), w2 (0))根据单层感知起学习算法,其学习过程如下:设感知器的两个输入为x1(0)=0和x2(0)=0,其期望输出为d(0)=0,实际输出为:y(0)=f(w1(0) x1(0)+ w2(0) x2(0)-θ(0))=f(0.2*0+0.4*0-0.3)=f(-0.3)=0实际输出与期望输出相同,不需要调节权值。

再取下一组输入:x1(0)=0和x2(0)=1,其期望输出为d(0)=1,实际输出为:y(0)=f(w1(0) x1(0)+ w2(0) x2(0)-θ(0))=f(0.2*0+0.4*1-0.3)=f(0.1)=1实际输出与期望输出相同,不需要调节权值。

再取下一组输入:x1(0)=1和x2(0)=0,其期望输出为d(0)=1,实际输出为:y(0)=f(w1(0) x1(0)+ w2(0) x2(0)-θ(0))=f(0.2*1+0.4*0-0.3)=f(-0.1)=0实际输出与期望输出不同,需要调节权值,其调整如下:θ(1)=θ(0)+η(d(0)- y(0))*(-1)=0.3+0.4*(1-0)*(-1)= -0.1w1(1)=w1(0)+η(d(0)- y(0))x1(0)=0.2+0.4*(1-0)*1=0.6w2(1)=w2(0)+η(d(0)- y(0))x2(0)=0.4+0.4*(1-0)*0=0.4再取下一组输入:x1(1)=1和x2(1)=1,其期望输出为d(1)=1,实际输出为:y(1)=f(w1(1) x1(1)+ w2(1) x2(1)-θ(1))=f(0.6*1+0.4*1+0.1)=f(1.1)=1实际输出与期望输出相同,不需要调节权值。

The weight updating rules of the perceptron and Kohonen neural network are _____.The limitation of the perceptron is that it can only model linearly separable classes. The decision boundary of RBF is__________linear______________________whereas the decision boundary of FFNN is __________________non-linear___________________________.Question Three:The activation function of the neuron of the Perceptron, BP network and RBF network are respectively________________; ________________; ______________.Question Four:Please present the idea, objective function of the BP neural networks (FFNN) and the learning rule of the neuron at the output layer of FFNN. You are encouraged to write down the process to produce the learning rule.Question Five:Please describe the similarity and difference between Hopfield NN and Boltzmann machine.相同:Both of them are single-layer inter-connection NNs.They both have symmetric weight matrix whose diagonal elements are zeroes.不同:The number of the neurons of Hopfield NN is the same as the number of the dimension (K) of the vector data. On the other hand, Boltzmann machine will have K+L neurons. There are L hidden neuronsBoltzmann machine has K neurons that serves as both input neurons and output neurons (Auto-association Boltzmann machine).Question Six:Please explain the terms in the above equation in detail. Please describe the weight updating equations of each node in the following FFNN using the BP learning algorithm. (PPT原题y=φ(net)= φ(w0+w1x1+w2x2))W0=w0+W1=w1+W2=w2+Question Seven:Please try your best to present the characteristics of RBF NN.(1)RBF networks have one single hidden layer.(2)In RBF the neuron model of the hidden neurons is different from the one of the output nodes.(3)The hidden layer of RBF is non-linear, the output layer of RBF is linear.(4)The argument of activation function of each hidden neuron in a RBF NN computes the Euclidean distance between input vector and the center of that unit.(5)RBF NN uses Gaussian functions to construct local approximations to non-linear I/O mapping.Question Eight:Generally, the weight vectors of all neurons of SOM is adjusted in terms of the following rule:w j(n+1)=w j(n)+η(n)h i(x)(d i(x)j)(x(n)-w j(n)).Please explain each term in the above formula.: weight value of the j-th neuron at iteration n: neighborhood functiondji: lateral distance of neurons i and j: the learning rate: the winning neuron most adjacent to XX: one input example。

人工神经网络练习题

1. 什么是人工神经网络?

人工神经网络是一种模仿人类神经系统结构和功能的计算模型。

它由许多人工神经元组成,通过模拟神经元之间的相互连接和信息

传递来研究和处理数据。

2. 人工神经网络的优点是什么?

人工神经网络具有以下优点:

- 能够进行非线性建模,适用于处理复杂的非线性问题。

- 具有自适应研究能力,能够通过反馈机制不断优化性能。

- 对于模式识别、分类和预测等任务表现良好。

- 具有容错性,即使部分神经元损坏,网络仍然可以正常工作。

3. 人工神经网络的主要组成部分有哪些?

人工神经网络主要由以下组成部分构成:

- 输入层:接收外部输入数据。

- 隐藏层:进行数据处理和特征提取。

- 输出层:给出最终的结果。

- 权重:神经元之间的连接强度。

- 激活函数:用于处理神经元的输入和输出。

4. 请解释反向传播算法的工作原理。

反向传播算法是一种用于训练人工神经网络的方法。

它通过将

输入数据传递给网络,并比较输出结果与期望结果之间的差异,然

后根据差异调整网络中的权重和偏置值。

该过程从输出层开始,逐

渐向前传播误差,然后通过梯度下降法更新权重和偏置值,最终使

网络逼近期望输出。

5. 请列举几种常见的用途人工神经网络的应用。

人工神经网络可以应用于许多领域,包括但不限于:

- 机器研究和模式识别

- 金融市场预测

- 医学诊断和预测

- 自动驾驶汽车

- 语音和图像识别

以上是关于人工神经网络的练习题,希望对您的学习有所帮助。

人工神经网络实验一表1中给出了某结构在多种状态下的特征向量,表2给出了某时刻结构的特征向量,请使用人工神经网络根据表2中的特征向量判断其所属状态。

表1特征1特征2特征3特征4特征5特征6特征7特征8特征9特征10状态10.6700.2580.8760.0210.3290.2610.8540.9420.4320.743状态20.9560.2520.1990.9880.2250.3790.0590.0150.4980.412状态30.3710.8560.3850.7390.4890.6850.7490.6600.3360.908状态40.8800.7370.6610.4230.7600.6800.0500.9700.6430.267状态50.1730.1360.2840.5150.5290.4610.4150.9900.3200.439状态60.9790.1180.4690.3340.6400.5670.3050.7880.9600.933表2特征1特征2特征3特征4特征5特征6特征7特征8特征9特征10时刻10.7940.2710.8930.0640.4320.2090.7940.8740.4380.726时刻20.5220.8750.2980.5820.5790.7830.6020.7680.2140.744时刻30.9210.7800.6700.4370.8750.7150.2020.9980.6740.447一、网络结构设计输入个数为10,输出个数为1,故神经元个数为1,结构如下图。

本题是一个模式识别问题,采用自组织竞争人工神经网络。

图1-1网络结构图画出6个状态在坐标系中如图1-2所示。

-0.20.20.40.60.811.2Input Vectorsp(1)p (2)图1-2状态向量图二、实验源程序如下(或见附件中M 文件):%创建输入向量X=[01;01]>>clusters=6;>>points=10;>>std_dev=0.05;>>P=nngenc(X,clusters,points,std_dev);>>plot(P(1,:),P(2,:),'+r')>>title('Input Vectors');>>xlabel('p(1)');>>ylabel('p(2)');%创建自组织竞争神经网络>>net=newc([01;01],6,.1);>>net=init(net);>>w=net.IW{1};>>hold off;>>plot(P(1,:),P(2,:),'+r');>>hold on;plot(w(:,1),w(:,2),'ob');>>xlabel('p(1)');>>ylabel('p(2)');>>hold off;>>net.trainParam.epochs=7;>>hold on;>>net=init(net);>>more off;>>net=train(net,P);TRAINR,Epoch0/7TRAINR,Epoch7/7TRAINR,Maximum epoch reached.%训练该网络hold on;net=init(net);more off;>>w=net.IW{1};>>delete(findobj(gcf,'color',[001]));>>hold off>>plot(P(1,:),P(2,:),'+r');>>hold off;>>hold on;plot(w(:,1),w(:,2),'ob');>>xlabel('p(1)');>>ylabel('p(2)');>>hold off;%仿真该网络>>p=[0.794;0.271];>>a=sim(net,p);>>ac=vec2ind(a)三、实验结果通过仿真计算得出时刻1属于状态1,时刻2属于状态3,时刻3属于状态4.各时刻对应的仿真状态图如下。

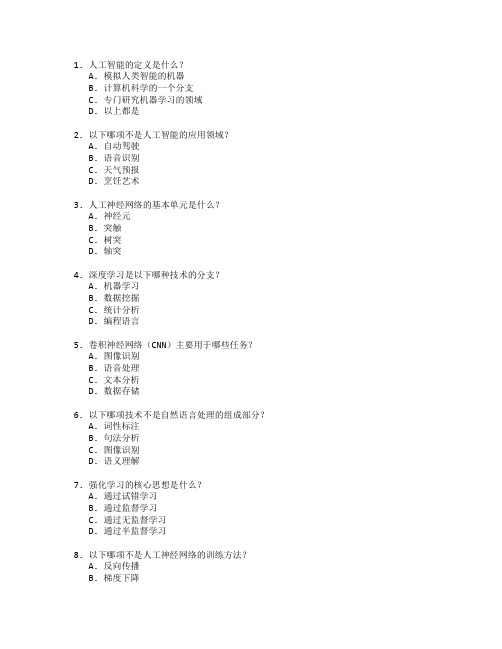

1. 人工智能的定义是什么?A. 模拟人类智能的机器B. 计算机科学的一个分支C. 专门研究机器学习的领域D. 以上都是2. 以下哪项不是人工智能的应用领域?A. 自动驾驶B. 语音识别C. 天气预报D. 烹饪艺术3. 人工神经网络的基本单元是什么?A. 神经元B. 突触C. 树突D. 轴突4. 深度学习是以下哪种技术的分支?A. 机器学习B. 数据挖掘C. 统计分析D. 编程语言5. 卷积神经网络(CNN)主要用于哪些任务?A. 图像识别B. 语音处理C. 文本分析D. 数据存储6. 以下哪项技术不是自然语言处理的组成部分?A. 词性标注B. 句法分析C. 图像识别D. 语义理解7. 强化学习的核心思想是什么?A. 通过试错学习B. 通过监督学习C. 通过无监督学习D. 通过半监督学习8. 以下哪项不是人工神经网络的训练方法?A. 反向传播B. 梯度下降C. 遗传算法D. 动态规划9. 什么是过拟合?A. 模型在训练数据上表现不佳B. 模型在测试数据上表现不佳C. 模型在训练数据上表现过好D. 模型在验证数据上表现过好10. 以下哪项不是防止过拟合的方法?A. 增加数据量B. 使用正则化C. 减少模型复杂度D. 增加模型复杂度11. 什么是迁移学习?A. 在不同任务间迁移数据B. 在不同模型间迁移参数C. 在不同领域间迁移知识D. 在不同设备间迁移模型12. 以下哪项不是人工智能的伦理问题?A. 隐私保护B. 算法偏见C. 能源消耗D. 数据安全13. 什么是生成对抗网络(GAN)?A. 一种用于生成数据的神经网络B. 一种用于分类数据的神经网络C. 一种用于回归数据的神经网络D. 一种用于聚类数据的神经网络14. 以下哪项不是人工智能的发展趋势?A. 自动化B. 智能化C. 个性化D. 传统化15. 什么是强化学习的奖励函数?A. 定义学习目标的函数B. 定义学习过程的函数C. 定义学习结果的函数D. 定义学习速度的函数16. 以下哪项不是人工智能的挑战?A. 数据隐私B. 算法透明度C. 能源效率D. 数据质量17. 什么是人工神经网络的激活函数?A. 决定神经元输出的函数B. 决定神经元输入的函数C. 决定神经元连接的函数D. 决定神经元状态的函数18. 以下哪项不是激活函数的类型?A. 线性函数B. 非线性函数C. 指数函数D. 对数函数19. 什么是人工神经网络的权重?A. 神经元之间的连接强度B. 神经元的输入信号C. 神经元的输出信号D. 神经元的状态20. 以下哪项不是人工神经网络的层类型?A. 输入层B. 隐藏层C. 输出层D. 存储层21. 什么是人工神经网络的前馈机制?A. 数据从输入层到输出层的单向流动B. 数据在网络中的双向流动C. 数据在网络中的循环流动D. 数据在网络中的随机流动22. 以下哪项不是人工神经网络的训练目标?A. 最小化损失函数B. 最大化准确率C. 最大化数据量D. 最大化泛化能力23. 什么是人工神经网络的反向传播算法?A. 一种用于更新权重的算法B. 一种用于初始化权重的算法C. 一种用于计算损失的算法D. 一种用于评估模型的算法24. 以下哪项不是人工神经网络的优化方法?A. 梯度下降B. 随机梯度下降C. 批量梯度下降D. 动态梯度下降25. 什么是人工神经网络的正则化?A. 一种防止过拟合的技术B. 一种增加模型复杂度的技术C. 一种减少数据量的技术D. 一种增加训练时间的技术26. 以下哪项不是人工神经网络的正则化方法?A. L1正则化B. L2正则化C. 弹性网络正则化D. L3正则化27. 什么是人工神经网络的批量归一化?A. 一种加速训练过程的技术B. 一种减少模型复杂度的技术C. 一种增加数据量的技术D. 一种减少训练时间的技术28. 以下哪项不是人工神经网络的归一化方法?A. 最小-最大归一化B. Z-score归一化C. 小数定标归一化D. 动态归一化29. 什么是人工神经网络的dropout?A. 一种防止过拟合的技术B. 一种增加模型复杂度的技术C. 一种减少数据量的技术D. 一种增加训练时间的技术30. 以下哪项不是人工神经网络的dropout方法?A. 随机丢弃神经元B. 固定丢弃神经元C. 按概率丢弃神经元D. 按层丢弃神经元31. 什么是人工神经网络的迁移学习?A. 在不同任务间迁移知识B. 在不同模型间迁移数据C. 在不同领域间迁移模型D. 在不同设备间迁移参数32. 以下哪项不是人工神经网络的迁移学习方法?A. 微调B. 特征提取C. 模型融合D. 数据增强33. 什么是人工神经网络的注意力机制?A. 一种模拟人类注意力的技术B. 一种增加模型复杂度的技术C. 一种减少数据量的技术D. 一种增加训练时间的技术34. 以下哪项不是人工神经网络的注意力机制方法?A. 自注意力B. 交叉注意力C. 全局注意力D. 局部注意力35. 什么是人工神经网络的Transformer模型?A. 一种基于注意力机制的模型B. 一种基于卷积机制的模型C. 一种基于循环机制的模型D. 一种基于生成机制的模型36. 以下哪项不是人工神经网络的Transformer模型特点?A. 并行计算B. 长距离依赖C. 局部依赖D. 自注意力37. 什么是人工神经网络的BERT模型?A. 一种预训练的语言表示模型B. 一种预训练的图像表示模型C. 一种预训练的语音表示模型D. 一种预训练的数据表示模型38. 以下哪项不是人工神经网络的BERT模型特点?A. 双向编码B. 单向编码C. 预训练D. 微调39. 什么是人工神经网络的GPT模型?A. 一种生成预训练的模型B. 一种分类预训练的模型C. 一种回归预训练的模型D. 一种聚类预训练的模型40. 以下哪项不是人工神经网络的GPT模型特点?A. 自回归B. 自编码C. 预训练D. 微调41. 什么是人工神经网络的GAN模型?A. 一种生成对抗网络B. 一种分类对抗网络C. 一种回归对抗网络D. 一种聚类对抗网络42. 以下哪项不是人工神经网络的GAN模型特点?A. 生成器B. 判别器C. 编码器D. 对抗训练43. 什么是人工神经网络的VAE模型?A. 一种变分自编码器B. 一种变分自回归器C. 一种变分自聚类器D. 一种变分自分类器44. 以下哪项不是人工神经网络的VAE模型特点?A. 编码器B. 解码器C. 生成器D. 变分推断45. 什么是人工神经网络的RNN模型?A. 一种循环神经网络B. 一种递归神经网络C. 一种卷积神经网络D. 一种生成神经网络46. 以下哪项不是人工神经网络的RNN模型特点?A. 序列数据处理B. 并行计算C. 长距离依赖D. 循环结构47. 什么是人工神经网络的LSTM模型?A. 一种长短期记忆网络B. 一种长长期记忆网络C. 一种短长期记忆网络D. 一种短短期记忆网络48. 以下哪项不是人工神经网络的LSTM模型特点?A. 遗忘门B. 输入门C. 输出门D. 更新门49. 什么是人工神经网络的GRU模型?A. 一种门控循环单元B. 一种门控递归单元C. 一种门控卷积单元D. 一种门控生成单元50. 以下哪项不是人工神经网络的GRU模型特点?A. 重置门B. 更新门C. 遗忘门D. 输出门51. 什么是人工神经网络的注意力机制?A. 一种模拟人类注意力的技术B. 一种增加模型复杂度的技术C. 一种减少数据量的技术D. 一种增加训练时间的技术52. 以下哪项不是人工神经网络的注意力机制方法?A. 自注意力B. 交叉注意力C. 全局注意力D. 局部注意力53. 什么是人工神经网络的Transformer模型?A. 一种基于注意力机制的模型B. 一种基于卷积机制的模型C. 一种基于循环机制的模型D. 一种基于生成机制的模型54. 以下哪项不是人工神经网络的Transformer模型特点?A. 并行计算B. 长距离依赖C. 局部依赖D. 自注意力55. 什么是人工神经网络的BERT模型?A. 一种预训练的语言表示模型B. 一种预训练的图像表示模型C. 一种预训练的语音表示模型D. 一种预训练的数据表示模型56. 以下哪项不是人工神经网络的BERT模型特点?A. 双向编码B. 单向编码C. 预训练D. 微调57. 什么是人工神经网络的GPT模型?A. 一种生成预训练的模型B. 一种分类预训练的模型C. 一种回归预训练的模型D. 一种聚类预训练的模型58. 以下哪项不是人工神经网络的GPT模型特点?A. 自回归B. 自编码C. 预训练D. 微调59. 什么是人工神经网络的GAN模型?A. 一种生成对抗网络B. 一种分类对抗网络C. 一种回归对抗网络D. 一种聚类对抗网络60. 以下哪项不是人工神经网络的GAN模型特点?A. 生成器B. 判别器C. 编码器D. 对抗训练1. D2. D3. A4. A5. A6. C7. A8. D9. C10. D11. C12. C13. A14. D15. A16. D17. A18. D19. A20. D21. A22. C23. A24. D25. A26. D27. A28. D29. A30. B31. A32. D33. A34. D35. A36. C37. A38. B39. A40. B41. A42. C43. A44. C45. A46. B47. A48. D49. A51. A52. D53. A54. C55. A56. B57. A58. B59. A60. C。

神经网络例题神经网络例题一、简介1.1 概述本章节主要介绍神经网络的基本概念和相关背景知识。

1.2 神经网络的原理本章节详细介绍神经网络的原理,包括神经元的模型、权重和偏置的计算方式、激活函数的选择等内容。

二、神经网络的构建2.1 网络结构设计本章节讲解如何根据具体问题设计神经网络的结构,包括网络层数、每层神经元的数量等。

2.2 数据预处理该章节介绍如何对原始数据进行预处理,包括数据清洗、特征选择和标准化等。

2.3 网络参数初始化本章节详细介绍神经网络中参数初始化的方法,包括随机初始化和其他常用方法。

三、神经网络的训练和优化3.1 损失函数选择本章节讲解如何选择适合的损失函数来反映模型的训练效果。

3.2 反向传播算法该章节详细介绍反向传播算法的原理和具体实现步骤,以及常见的优化算法,如梯度下降、动量法等。

3.3 训练技巧和策略本章节介绍训练神经网络的一些常用技巧和策略,包括学习率的调整、批量归一化、正则化等。

四、神经网络的应用4.1 语音识别该章节以语音识别为例,介绍神经网络在自然语言处理领域的应用。

4.2 图像处理本章节以图像处理为例,介绍神经网络在计算机视觉领域的应用。

4.3 自动驾驶该章节以自动驾驶为例,介绍神经网络在智能交通领域的应用。

五、总结和展望本章节对全文进行总结,并展望神经网络在未来发展的前景。

附件:本文档涉及的附件包括示例代码、训练数据集和实验结果。

法律名词及注释:1.神经网络:一种模仿生物神经网络工作方式的计算模型。

2.反向传播算法:一种常用于训练神经网络的优化算法,通过计算损失函数的梯度来调整网络参数。

3.梯度下降:一种常用的优化算法,在梯度的相反方向更新参数以最小化损失函数。

4.学习率:在梯度下降算法中控制每次参数更新的步长的超参数,影响训练速度和准确性。

1、什么就是 BP 网络得泛化能力?如何保证 BP 网络具有较好得泛化能力?(5分)解:(1)BP网络训练后将所提取得样本对中得非线性映射关系存储在权值矩阵中,在其后得工作阶段,当向网络输入训练时未曾见过得非样本数据时,网络也能完成由输入空间向输出空间得正确映射。

这种能力称为多层感知器得泛化能力,它就是衡量多层感知器性能优劣得一个重要方面。

(2)网络得性能好坏主要瞧其就是否具有很好得泛化能力,而对泛化能力得测试不能用训练集得数据进行,要用训练集以外得测试数据来进行检验。

在隐节点数一定得情况下,为获得更好得泛化能力,存在着一个最佳训练次数t,训练时将训练与测试交替进行,每训练一次记录一训练均方误差,然后保持网络权值不变,用测试数据正向运行网络,记录测试均方误差,利用两种误差数据得出两条均方误差随训练次数变化得曲线,测试、训练数据均方误差曲线如下图1所示。

训练次称为最佳训练次数,当超过这个训练次数后,训练误差次数减小而测试误差数t则开始上升,在此之前停止训练称为训练不足,在此之后称为训练过度。

图1、测试、训练数据均方误差曲线2、什么就是 LVQ 网络?它与 SOM 网络有什么区别与联系?(10 分)解:(1)学习向量量化(learning vector quantization,LVQ)网络就是在竞争网络结构得基础上提出得,LVQ将竞争学习思想与监督学习算法相结合,减少计算量与储存量,其特点就是网络得输出层采用监督学习算法而隐层采用竞争学习策略,结构就是由输入层、竞争层、输出层组成。

(2)在LVQ网络学习过程中通过教师信号对输入样本得分配类别进行规定,从而克服了自组织网络采用无监督学习算法带来得缺乏分类信息得弱点。

自组织映射可以起到聚类得作用,但还不能直接分类与识别,因此这只就是自适应解决模式分类问题中得第一步,第二步就是学习向量量化,采用有监督方法,在训练中加入教师信号作为分类信息对权值进行细调,并对输出神经元预先指定其类别。

3、设计一个神经网络对图一中得三类线性不可分模式进行分类,期望输出向量分别用(1, -1, -1)T、 (-1, 1, -1) T、 (-1, -1, 1) T代表三类,输入用样本坐标。

要求:(1) 选择合适得隐节点数;(2)用 BP 算法训练网络,对图中得 9 个样本进行正确分类。

(15 分)分析:对于一个BP 神经网络,首先要明确输入,输出, 隐层节点个数。

对于本题,输入就是点坐标组成得2*9得矩阵,输入节点个数为2,期望输出向量分别用(1, -1, -1)T 、 (-1, 1, -1)T 、 (-1, -1, 1)T 表示,至于隐层节点得个数并没有确切得方法, 根据经验公式α++=l n m (m 为隐层节点数;n 为输入层节点数;l 为输出节点数;α为1~10之间得常数),首先确定隐层节点数为5,逐渐增加隐层节点数量,然后观察其对训练误差得影响,最终选出最合适得隐层节点数量。

隐层节点数 误差精度 训练次数 分类结果正确率5 0、3 66491 100% 7 0、3 31981 100% 9 0、3 25338 100% 10 0、3 20770 100% 12 0、3 14052 100% 14 0、3 11622 100%录不同隐层节点数得情况下达到相同得训练精度所需要得训练次数,当隐层节点数为M=5时,在训练次数为66491时,结果达到训练精度; 当隐层节点数M=7时,在训练次数到达31981时,结果达到训练精度;当隐层节点数M=9时时,在训练次数达到25338时,结果达到训练精度;当隐层节点数M=10时,在训练次数达到20770时,结果达到训练精度;当隐层节点数M=12时,在训练次数达到14052时,结果达到训练精度;当隐层节点数M=14时,在训练次数达到11622时,结果达到训练精度,由此可见,在一定范围内,隐层节点数越多,达到训练精度时所用得训练次数越少,所用训练时间则越少。

因此选择隐层节点数为14。

学习率0、3,误差精度在0、1以下,输出结果与导师信号对比,输出结果都为正确,正确率达到100%。

具体程序见附件一或者BPclassify 、m 。

4、试设计一个吸引子为X a =(0110) T,X b =(1001)T 得离散Hopfield 人工神经网络。

其权值与阈值在 [-1,1]区间取值,试求权值与阈值。

(10 分) 解:吸引子得分布就是由网络得权值(包括阈值)决定得,设计吸引子得核心就就是如何设计一组合适得权值。

为了使所设计得权值满足要求,权值矩阵应符合以下要求:(a) 为保证异步方式工作时网络收敛,W 应为对称阵。

(b) 为保证同步方式工作时网络收敛,W 应为非负定对称阵。

(c) 保证给定得样本就是网络得吸引子,并且要有一定得吸引域。

具体设计时,这里采用了联立方程法:以 4 节点 DHNN 为例,说明权值设计得联立方程法。

考虑到w ij = w ji ,w ii = 0,对稳态x(t +1) = x(t)。

对于状态 X a = (1001)T ,各节点净输入应满足:net1=w 12×0+w 13×0+w 14×1−T1=w 14−T1>0 (1) net2=w 12×1+w 23×0+w 24×1−T2=w 12+w 24−T2<0 (2) net3=w 13×1+w 23×0+w 34×1−T3=w 13+w 34−T3<0 (3) net4=w 14×1+w 24×0+w 34×0–T4=w 14–T4>0 (4) 对于 X b = (0110)T 状态,各节点净输入应满足:net1=w 12×1+w 13×1+w 14×0−T1=w 12+w 13−T1<0 (5) net2=w 12×0+w 23×1+w 24×0−T2=w 23−T2>0 (6) net3=w 13×0+w 23×1+w 34×0−T3=w 23−T3>0 (7) net4=w 14×0+w 24×1+w 34 ×1–T4=w 24+w 34–T4<0 (8)联立以上8项不等式,可求出未知量得允许取值范围。

如取w 14 =0、7,则由式(1) 有 -1≤T 1<0、7,取T 1= 0、6;则由式(4)有 -1≤T 4<0、7,取T 4= 0、6;取w 12 =0、4,由式(5),有 -1≤w 13< 0、2,取w 13 = 0、1;取w 24 =0、2由式(2),有0、6<T 2 ≤1,取T 2 = 0、8;由式(6),有0、8 < w 23 ≤1,取w 23 = 0、9;由式(7), 有−1 ≤ T 3 < 0、9,取T 3 = 0、4;由式(3,8),有-1 < w 34 ≤ 0、3,取w 34=0、2。

可以验证,利用这组参数构成得 DHNN 网对于任何初态最终都将演变到两吸引子 X a =(1001)T 与X b =(0110)T 。

整理权值与阈值为:⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=03.02.07.03.009.01.02.09.004.07.01.04.00W ⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=6.04.08.06.0T5、下面给出得训练集由玩具兔与玩具熊组成。

输入样本向量得第一个分量代表玩具得重量,第二个分量代表玩具耳朵得长度,教师信号为-1表示玩具兔,教师信号为1表示玩具熊。

(1) 用 matlab 训练一个感知器,求解此分类问题。

(需附上 matlab 程序)(2) 用输入样本对所训练得感知器进行验证。

(15 分)分析:对于本题,输入就是样本组成得2*8得矩阵,输入节点个数为2,输出由导师信号可知分为两类。

两个输入分量在几何上构成一个二维平面,输入样本可以用该平面上得一个点表示,玩具重量与长度在坐标中标出,可以瞧出明显分布在两个区域,可以用一条线分开分为两类,在线上方得输出结果应大于0,在线下方得输出结果应小于0。

权向量为2*9得矩阵,输入得第一个权向量权值赋予较小得非零随机数,每一个新得权向量都由上一个权向量调整,下一次循环第1个权向量由第9个权向量来调整。

对于这样得样本线性可分,经过几次调整后就稳定到一个权向量,将样本正确分类得权向量不就是唯一得。

具体程序见附件二或者ganzhiqi、m。

输出分类结果如下图所示。

训练次数分类结果正确率4 100%3 100%5 100%图2、感知器在二维平面得分类结果附件一:第三题程序clear all;%%BP算法初始化D=[1,-1,-1; 1,-1,-1; 1,-1,-1; -1,1,-1; -1,1,-1;-1,1,-1; -1,-1,1; -1,-1,1; -1,-1,1]';X=[0、75,0、75; 0、75,0、125; 0、25,0、25; 0、25,0、75; 0、5,0、125; 0、75,0、25; 0、25,0、5; 0、5,0、5; 0、75,0、5]'; [N,n]=size(X);[L,Pd]=size(D);%M=ceil(sqrt(N*L))+7;ceil函数为正无穷方向取整m=14; %隐层节点数%初始化权矩阵%输入层到隐层权矩阵V=rand(N,m);%隐层到输出层权矩阵W=rand(m,L);%开始训练,转移函数选择双极性Sigmoid函数Q=100000;%训练次数计数器E=zeros(Q,1);%误差Emin=0、3; %训练要求精度learnr=0、2; %学习率q=1;%训练次数计数,批训练%%权值调整while q<Qnetj=V、'*X;Y=(1-exp(-netj))、/(1+exp(-netj));netk=W、'*Y;O=(1-exp(-netk))、/(1+exp(-netk));E(q)=sqrt(sum(sum((D-O)、^2))/2); %计算总误差if E(q)<Eminbreak;endDelta_o=(D-O)、*(1-O、^2)、/2;W=W+learnr*(Delta_o*Y、')、'; %隐层与输出层间得权矩阵调整Delta_y=(W*Delta_o)、*(1-Y、^2)、/2;V=V+learnr*(Delta_y*X、')、'; %输入层与隐层间得权矩阵调整q=q+1;end%%输出结果qO=sign(O) %符号函数取整A=find(O~=D); %与计算输出与导师信号不同得个数length(A) %分类结果错误得个数附件二:第五题程序clc;clear%%单层感知器初始化X=[1,4;1,5;2,4;2,5;3,1;3,2;4,1;4,2]; %输入信号d=[-1;-1;-1;-1;1;1;1;1]; %输入导师信号w=zeros(2,9);w(:,1)=rand(2,1); %第一组权值赋予较小得非零随机数o=zeros(8,1); %输出结果net=zeros(8,1); %净输入netlearnr=0、01; %学习率为0、1n=0; %循环次数%%调整权值while n<100 %训练次数最大设为100次for i=1:8net(i)=X(i,:)*w(:,i); %计算净输入neto(i)=sign(net(i)); %计算输出,转移函数为符号函数w(:,i+1)=w(:,i)+learnr*(d(i)-o(i))*X(i,:)'; %调整权值w(:,1)=w(:,9); %最后一组权值赋值给第一组权endn=n+1if d==o %如果输出等于导师信号,那么训练停止breakendend%%结果输出x1=[1,1,2,2]; %将两组数据在图中标出y1=[4,5,4,5];x2=[3,3,4,4];y2=[1,2,1,2];scatter(x1,y1,'r')%画点hold on;scatter(x2,y2,'b')x=-1:0、01:5;y=-w(1,1)/w(2,1)*x;%得到训练过后得权都一样,取出第一组权确定直线,将两组数据分开hold on;plot(x,y)。