MATLAB神经网络工具箱及实验要求

- 格式:ppt

- 大小:692.00 KB

- 文档页数:13

在Matlab中使用神经元网络进行数据拟合的技巧在Matlab中使用神经网络进行数据拟合的技巧引言:在现代数据科学领域中,数据拟合是一项非常重要的任务。

数据拟合可以理解为通过数学模型来拟合已知的数据,以便更好地理解和预测未知的数据。

在数据拟合方法中,神经网络被广泛应用。

神经网络是一种模拟生物神经网络的人工智能方法,以其灵活性和强大的拟合能力受到了广大研究者的青睐。

在本文中,将探讨如何在Matlab中使用神经网络进行数据拟合,并分享一些技巧和经验。

一、Matlab中的神经网络工具箱Matlab提供了强大的神经网络工具箱,使得我们能够轻松地构建并训练神经网络模型。

该工具箱包含了多种神经网络类型,如前馈神经网络、递归神经网络等,并提供了丰富的功能和参数调整选项。

在使用神经网络进行数据拟合之前,首先需要导入神经网络工具箱,并了解一些基本的函数和工具。

二、数据准备和预处理在进行数据拟合之前,我们需要准备和预处理原始数据,以确保数据的完整性和准确性。

数据准备的过程包括数据收集、数据清洗、数据变换等。

在Matlab中,可以使用一些内置函数和工具箱来帮助我们进行数据准备和预处理。

例如,可以使用Matlab的数据导入工具箱来导入和预览数据,使用数据清洗工具箱来清洗和去除异常值,使用数据变换方法来调整数据的规模和分布。

三、神经网络模型设计神经网络模型的设计是数据拟合中的重要步骤。

在设计模型时,需要选择适当的网络结构和参数设置。

常见的网络结构包括单层感知器、多层感知器、径向基函数网络等。

在选择网络结构时,需要考虑数据的特点和需求,以及模型的复杂度和计算效率。

此外,还需要确定模型的激活函数、误差函数和学习算法等参数。

这些参数的选择将直接影响到模型的拟合效果和性能。

在Matlab中,可以使用图形化界面或编程的方式来构建和调整神经网络模型。

四、神经网络的训练和验证神经网络的训练是数据拟合过程中的核心步骤。

训练过程通过不断调整网络的权重和偏置值,使得网络能够逼近目标函数。

快速入门Matlab神经网络的基本步骤神经网络是一种模仿人类大脑神经元之间相互连接和信息传递方式的数学模型。

它通过对大量数据的学习和分析,能够模拟和预测一些复杂的问题。

Matlab是一种功能强大的数值计算软件,它提供了丰富的神经网络工具箱,使得神经网络的设计和实现变得简单而高效。

本文将介绍Matlab神经网络的基本步骤,帮助读者快速入门。

第一步:安装和配置Matlab神经网络工具箱首先,确保已经正确安装了Matlab软件。

然后,在Matlab的主界面上找到"Add-Ons",点击进入。

在搜索栏中输入"Neural Network Toolbox",然后点击安装。

安装完成后,重启Matlab软件。

第二步:准备数据集神经网络的训练和测试需要大量的数据集。

在准备数据集时,需要确保数据集的质量和完整性。

一般来说,数据集应该包括输入和输出两部分,且输入和输出的维度需要匹配。

在Matlab中,可以通过导入已有的数据集文件或者手动创建数据集矩阵来准备数据集。

确保数据集是以矩阵的形式存储,且每一行表示一个样本,每一列表示一个特征或者标签。

第三步:创建神经网络模型在Matlab中,可以使用命令创建神经网络模型。

常见的创建方式包括使用神经网络应用程序、使用nprtool命令或者手动编写代码创建。

使用神经网络应用程序是最简单的方式。

在Matlab主界面上找到"Apps",点击进入"Neural Network Designer"。

在应用程序中,可以通过拖拽和调整网络结构、设置神经元的参数等方式创建自定义的神经网络。

使用nprtool命令可以更加灵活地创建神经网络。

在Matlab的命令行窗口中输入"nprtool",打开神经网络模型创建工具。

在工具中,可以根据需要选择不同的网络结构和参数,进行更加精细的控制。

手动编写代码创建神经网络具有最高的灵活性。

Matlab中的神经网络算法实现指南1. 引言神经网络是一种基于生物神经系统的模型,旨在模拟人脑的学习和决策过程。

在现代机器学习领域,神经网络被广泛应用于图像识别、语言处理、预测分析等各种任务中。

而Matlab作为一种功能强大的数值计算和可视化软件,提供了丰富的神经网络工具箱,可以帮助开发人员快速实现和调试各种神经网络算法。

本文将介绍Matlab中的神经网络工具箱,并提供一些实现神经网络算法的指南。

2. Matlab中的神经网络工具箱Matlab提供了一个名为"Neural Network Toolbox"的工具箱,包含了大量的函数和工具,用于构建、训练和评估神经网络模型。

该工具箱支持多种类型的神经网络结构,包括前馈神经网络、递归神经网络、卷积神经网络等。

此外,Matlab还提供了各种用于优化神经网络的算法,如反向传播算法、遗传算法等。

3. 构建神经网络模型在Matlab中,我们可以使用"feedforwardnet"函数来构建一个前馈神经网络模型。

该函数接受一个包含神经网络层结构的向量作为输入参数,并返回一个神经网络对象。

我们可以通过修改这个向量的元素来调整神经网络的结构和参数。

例如,下面的代码展示了如何构建一个包含两个隐藏层的前馈神经网络模型:```matlabnet = feedforwardnet([10, 5]);```4. 导入和预处理数据导入和预处理数据对于构建和训练神经网络模型至关重要。

Matlab提供了各种用于数据导入和预处理的函数和工具。

例如,可以使用"csvread"函数来导入CSV 格式的数据文件;可以使用"mapminmax"函数来对数据进行归一化处理;可以使用"splittingData"函数将数据划分为训练集、验证集和测试集等。

5. 为神经网络模型训练数据在Matlab中,我们可以通过调用"train"函数来训练神经网络模型。

MATLAB神经网络工具箱的使用指南引言:在当今信息时代的浪潮中,神经网络作为一种模仿人类神经系统运行方式的数学计算模型,被广泛应用于各个领域。

而MATLAB神经网络工具箱作为一款功能强大、易于使用的软件工具,成为许多科学家和工程师进行神经网络研究和应用实践的首选。

本文旨在为读者提供MATLAB神经网络工具箱的全面介绍,并指导读者如何利用其进行神经网络的搭建、训练和应用。

一、神经网络基础知识在正式介绍MATLAB神经网络工具箱之前,我们先来了解一些神经网络的基础知识。

神经网络由输入层、隐藏层和输出层组成,其中输入层接收外部输入,隐藏层进行数据转换和处理,输出层输出最终结果。

神经网络模拟人类大脑的工作原理,通过调整神经元之间的连接权重来实现对输入数据的学习和对未知数据的预测。

二、MATLAB神经网络工具箱的使用1. 环境准备在使用MATLAB神经网络工具箱之前,我们需要先安装MATLAB软件,并确保已经安装了神经网络工具箱。

安装完成后,可以通过在命令窗口输入“nntool”命令来打开神经网络工具箱界面。

2. 神经网络搭建在神经网络工具箱中,可以通过图形用户界面进行神经网络的搭建。

点击界面左上角的“New”按钮,选择“Feedforwardnet”或“Patternnet”等网络类型,并设置输入层、隐藏层和输出层的节点数。

接下来,可以通过拖拽节点和连接来构建网络。

此外,还可以使用“Layer”和“Connection”选项卡来对网络的结构和参数进行进一步设置。

3. 数据准备成功搭建神经网络后,我们需要准备用于训练和测试的数据。

MATLAB提供了丰富的数据处理函数,可以将数据从不同格式的文件中导入,或者通过代码生成。

导入数据后,可以使用数据处理工具对数据进行清洗、归一化等预处理操作,以提高神经网络的训练效果。

4. 神经网络训练数据准备完毕后,可以通过神经网络工具箱提供的训练函数对神经网络进行训练。

常用的训练函数包括“trainlm”、“traingd”、“trainrp”等,它们采用不同的优化算法来调整网络中的连接权重。

matlab神经网络工具箱简介MATLAB软件中包含MATLAB神经网络工具箱,工具箱以人工神经网络为基础,只要根据自己需要调用相关函数,就可以完成网络设计、权值初始化、网络训练等,MATLAB神经网络工具箱包括的网络有感知器、线性网络、BP神经网络、径向基网络、自组织网络和回归网络,BP神经网络工具箱主要包括newff,sim和train三个神经网络函数各函数的解释如下:1 newff::::BP神经网络参数设置函数神经网络参数设置函数神经网络参数设置函数神经网络参数设置函数函数功能:构建一个BP神经网络。

函数形式:net = newff(P,T,S,TF,BTF,BLF,PF,IPF,OPF,DDF)P:输入数据矩阵T:输出数据矩阵S:隐含层节点数TF:节点传递函数,包括硬限幅传递函数hardlim,对称硬限幅传递函数hardlims,线性传递函数purelin,正切S型传递函数tansig,对数S型传递函数logsigBTF:训练函数,包括梯度下降BP算法训练函数traingd,动量反传的梯度下降BP算法训练函数traingdm,动态自适应学习率的梯度下降BP算法训练函数traingda,动量反传和动态自适应学习率的梯度下降BP算法训练函数traingdx,Levenberg_Marquardt 的BP算法训练函数trainlmBLF:网络学习函数,包括BP学习规则learngd,带动量项的BP 学习规则learngdmPF:性能分析函数,包括均值绝对误差性能分析函数mae,均方差性能分析函数mse IPF:输入处理函数OPF:输出处理函数DDF:验证数据划分函数一般在使用过程中设置前六个参数,后四个参数采用系统默认参数。

2 train::::BP神经网络训练函数神经网络训练函数神经网络训练函数神经网络训练函数函数功能:用训练数据训练BP神经网络。

函数形式:[net,tr] = train(NET,X,T,Pi,Ai)NET:待训练网络X:输入数据矩阵T:输出数据矩阵Pi:初始化输入层条件Ai:初始化输出层条件net:训练好的网络tr:训练过程记录一般在使用过程中设置前三个参数,后两个参数采用系统默认参数。

Matlab中的神经网络工具箱介绍与使用神经网络是一种模拟人脑思维方式的计算模型,它通过由多个神经元组成的网络,学习数据的特征和规律。

在计算机科学领域,神经网络被广泛应用于模式识别、数据挖掘、图像处理等诸多领域。

Matlab作为一种功能强大的科学计算软件,提供了专门用于神经网络设计和实现的工具箱。

本文将介绍Matlab中的神经网络工具箱,并探讨其使用方法。

一、神经网络工具箱的概述Matlab中的神经网络工具箱(Neural Network Toolbox)是一款用于构建和训练神经网络的软件包。

它提供了丰富的函数和工具,可用于创建不同类型的神经网络结构,如前向神经网络、反向传播神经网络、径向基函数神经网络等。

神经网络工具箱还包括了各种训练算法和性能函数,帮助用户对神经网络进行优化和评估。

二、神经网络的构建与训练在使用神经网络工具箱前,我们需要先了解神经网络的基本结构和原理。

神经网络由输入层、隐藏层和输出层组成,每一层都包含多个神经元。

输入层接受外部输入数据,通过权重和偏置项传递给隐藏层,最终输出到输出层,形成网络的输出结果。

构建神经网络的第一步是定义网络的结构,可以使用神经网络工具箱中的函数创建不同层和神经元的结构。

例如,使用feedforwardnet函数可以创建一个前向神经网络,输入参数指定了每个隐藏层的神经元数量。

然后,可以使用train函数对神经网络进行训练。

train函数可以选择不同的训练算法,如标准反向传播算法、Levenberg-Marquardt算法等。

通过设置训练参数,例如训练迭代次数和学习速率等,可以对网络进行优化。

三、神经网络的应用案例神经网络在许多领域都有广泛的应用,下面以图像分类为例,介绍如何使用神经网络工具箱来训练一个图像分类器。

首先,我们需要准备训练数据和测试数据。

训练数据通常包含一组已经标记好的图像和相应的标签。

为了方便处理,我们可以将图像转化为一维向量,并将标签转化为二进制编码。

matlab神经网络工具箱怎么用标题:Matlab神经网络工具箱的使用方法导言:Matlab神经网络工具箱是一个功能强大的工具,用于建立、训练和评估各种类型的神经网络。

本文将介绍如何使用Matlab神经网络工具箱进行神经网络的建立、训练和评估,帮助您更好地理解和使用这个工具箱。

一、Matlab神经网络工具箱的安装首先,您需要确保已成功安装了Matlab软件。

然后,您可以通过以下步骤来安装Matlab神经网络工具箱:1. 打开Matlab软件。

2. 在工具栏上选择“工具”菜单。

3. 在下拉菜单中选择“添加预定目录”。

4. 在弹出的窗口中,选择“文件夹”选项。

5. 点击“浏览”按钮,并选择包含神经网络工具箱的文件夹。

6. 点击“选择文件夹”按钮,然后点击“添加文件夹”按钮。

7. 点击“关闭”按钮,完成神经网络工具箱的安装。

二、神经网络的建立Matlab神经网络工具箱提供了多种类型的神经网络模型,如前馈神经网络、递归神经网络和自组织神经网络。

下面我们以前馈神经网络为例,介绍神经网络的建立方法:1. 打开Matlab软件,并在命令窗口中输入“nprtool”命令,打开“神经网络模式选择器”窗口。

2. 在“神经网络模式选择器”窗口中,选择“构建”按钮。

3. 在“神经网络模式选择器”窗口中,选择“前馈神经网络”选项,并点击“下一步”按钮。

4. 在“选择网络架构”窗口中,选择神经网络的层数、神经元数量和输入、输出数据的维度。

5. 点击“下一步”按钮,然后点击“完成”按钮,完成神经网络的建立。

三、神经网络的训练神经网络的训练是指通过将已知的输入和输出数据进行反复迭代调整网络参数,从而使网络能够更好地拟合输入输出之间的关系。

下面我们介绍神经网络的训练方法:1.在命令窗口中输入“trainlm”命令,选择Levenberg-Marquardt算法作为训练函数。

2.输入训练数据和目标数据,通过“trains”命令开始训练神经网络。

12.Matlab神经⽹络⼯具箱概述:1 ⼈⼯神经⽹络介绍2 ⼈⼯神经元3 MATLAB神经⽹络⼯具箱4 感知器神经⽹络5 感知器神经⽹络5.1 设计实例分析1 clear all;2 close all;3 P=[0011;0101];4 T=[0111];5 %建⽴神经⽹络6 net=newp(minmax(P),1,'hardlim','learnp');7 %对神经⽹络进⾏训练,net是建⽴⽹络,P是输⼊向量,T是⽬标向量8 net=train(net,P,T);9 %对⽹络进⾏仿真10 Y=sim(net,P);11 %绘制建模点12 plotpv(P,T);13 %绘制分界线14 plotpc(net.iw{1,1},net.b{1});1 clear all;2 close all;3 P=[-0.5 -0.50.4 -0.1 -0.8;-0.50.5 -0.30.20.9];4 T=[11001];5 plotpv(P,T);6 %建⽴感知器⽹络7 net=newp(minmax(P),1,'hardlim','learnpn');8 hold on;9 linehandle=plot(net.IW{1},net.b{1});10 E=1;11 net.adaptParam.passes=10;12 %误差没有达到要求会持续不断的训练13while mae(E)14 %进⾏感知器⽹络的训练15 [net,Y,E]=adapt(net,P,T);16 linehandle=plotpc(net.IW{1},net.b{1},linehandle);17 drawnow;18 end19 %对训练好的⽹络进⾏保存,保存成net120 save net1 net;21set(gcf,'position',[50,50,400,400]);1 clear all;2 close all;3 %加载⽹络4 load net1.mat;5 X=[-0.40.20.8;-0.70.30.9];6 %对⽹络进⾏仿真,输⼊向量为X7 Y=sim(net,X);8 figure;9 %绘制样本点和分界线10 plotpv(X,Y);11 plotpc(net.IW{1},net.b{1});12set(gcf,'position',[50,50,400,400]);5.2 线性神经⽹络1 clear all;2 close all;3 P=[1.02.134];4 T=[2.04.015.98.0];5 %获取最⼤的学习速率6 lr=maxlinlr(P);7 net=newlin(minmax(P),1,0,lr);8 %最⼤学习次数是3009 net.trainParam.epochs=300;10 %训练的⽬标误差为0.0511 net.trainParam.goal=0.05;12 net=train(net,P,T);13 Y=sim(net,P)6 设计实例分析1 clear all;2 close all;3 t=0:pi/10:4*pi;4 X=t.*sin(t);5 T=2*X+3;6 figure;7 plot(t,X,'+-',t,T,'+--');8 legend('系统输⼊','系统输出');9set(gca,'xlim',[04*pi]);10set(gcf,'position',[50,50,400,400]);11 net=newlind(X,T);12 %对⽹络进⾏仿真13 y=sim(net,X);14 figure;15 plot(t,y,'+:',t,y-T,'r:');16 legend('⽹络预测输出','误差');17set(gca,'xlim',[04*pi]);18set(gcf,'position',[50,50,400,400]); 7 BP⽹络7.1 BP⽹络的创建7.2 BP⽹络实例分析1 clear all;2 clear all;3 P=[012345678910];4 T=[01234321234];5 %隐含层为10个神经元6 net=newff(P,T,10);7 net.trainParam.epochs=100;8 %进⾏训练9 net=train(net,P,T);10 %对⽹络进⾏仿真11 Y=sim(net,P);12 figure;13 plot(P,T,P,Y,'o');BP神经⽹络进⾏曲线拟合1 clear all;2 clear all;3 P=-1:0.05:1;4 T=sin(2*pi*P)+0.1*randn(size(P));5 net=newff(P,T,20,{},'trainbr');6 net.trainParam.show=10;7 net.trainParam.epochs=50;8 net=train(net,P,T);9 Y=sim(net,P);10 figure;11 plot(P,T,'-',P,Y,'+');12 legend('原始信号','⽹络输出信号'); 13set(gcf,'position',[50,50,600,300]); 8 径向基审计⽹络1 clear all;2 close all;3 P=[12345];4 T=[2.13.45.46.95.6];5 net=newrb(P,T);6 x=2:0.5:57 y=sim(net,x)9 ⼴义回归神经⽹络1 clear all;2 close all;3 %输⼊向量4 P=1:20;5 %输出向量6 T=3*sin(P);7 net=newgrnn(P,T,0.2);8 y=sim(net,P);9 figure;10 plot(P,T,':+',P,T-y,'-o'); 10 概率神经⽹络1 clear all;2 close all;3 P=[1:8];4 Tc=[23123211];5 T=ind2vec(Tc)6 net=newpnn(P,T);7 Y=sim(net,P);8 Yc=vec2ind(Y)。

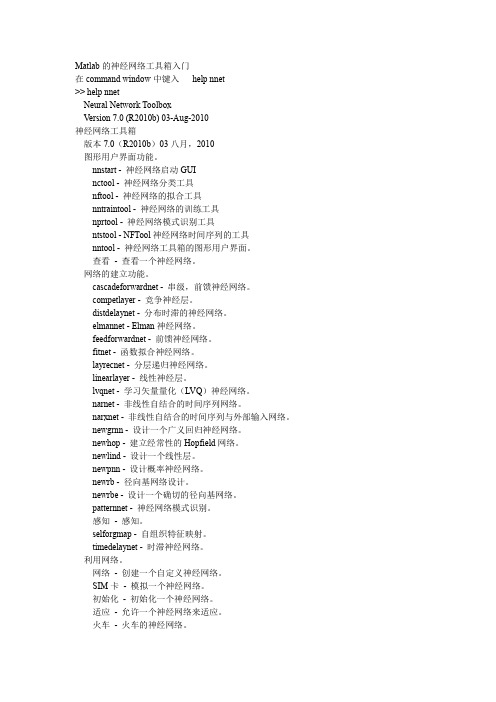

Matlab的神经网络工具箱入门在command window中键入help nnet>> help nnetNeural Network ToolboxVersion 7.0 (R2010b) 03-Aug-2010神经网络工具箱版本7.0(R2010b)03八月,2010图形用户界面功能。

nnstart - 神经网络启动GUInctool - 神经网络分类工具nftool - 神经网络的拟合工具nntraintool - 神经网络的训练工具nprtool - 神经网络模式识别工具ntstool - NFTool神经网络时间序列的工具nntool - 神经网络工具箱的图形用户界面。

查看- 查看一个神经网络。

网络的建立功能。

cascadeforwardnet - 串级,前馈神经网络。

competlayer - 竞争神经层。

distdelaynet - 分布时滞的神经网络。

elmannet - Elman神经网络。

feedforwardnet - 前馈神经网络。

fitnet - 函数拟合神经网络。

layrecnet - 分层递归神经网络。

linearlayer - 线性神经层。

lvqnet - 学习矢量量化(LVQ)神经网络。

narnet - 非线性自结合的时间序列网络。

narxnet - 非线性自结合的时间序列与外部输入网络。

newgrnn - 设计一个广义回归神经网络。

newhop - 建立经常性的Hopfield网络。

newlind - 设计一个线性层。

newpnn - 设计概率神经网络。

newrb - 径向基网络设计。

newrbe - 设计一个确切的径向基网络。

patternnet - 神经网络模式识别。

感知- 感知。

selforgmap - 自组织特征映射。

timedelaynet - 时滞神经网络。

利用网络。

网络- 创建一个自定义神经网络。

SIM卡- 模拟一个神经网络。

初始化- 初始化一个神经网络。

MATLAB技术神经网络拟合导言:神经网络是一种重要的机器学习技术,具有强大的模式识别和函数拟合能力。

MATLAB作为一种专业的科学计算软件,提供了丰富的工具箱和功能,用于设计和实现神经网络模型。

本文将介绍MATLAB技术在神经网络拟合方面的应用,以及相关的算法原理和实践案例。

一、神经网络概述神经网络是受到人类神经系统启发的一种计算模型,可以通过构建具有多个神经元层的网络结构来实现模式识别和函数拟合。

每个神经元通过权重和激活函数来计算输入信号的输出,多个神经元按照特定的连接方式形成网络。

神经网络的训练过程可以通过调整权重和激活函数的参数来优化模型的性能。

二、MATLAB神经网络工具箱MATLAB提供了神经网络工具箱,用于方便地设计和实现神经网络模型。

工具箱包含了各种神经网络算法和函数,支持多种拓扑结构和学习算法,提供了丰富的可视化和调试工具。

通过使用神经网络工具箱,用户可以快速构建自己的神经网络模型,并进行训练和测试。

三、神经网络拟合问题神经网络拟合是指通过神经网络模型来逼近某个未知函数的过程。

这种拟合方法可以应用于多个领域,如数据挖掘、金融预测、图像处理等。

在MATLAB中,可以通过使用神经网络工具箱中的函数和工具来解决各种拟合问题。

1. 函数拟合问题函数拟合是神经网络最常见的应用之一。

给定一组输入输出的样本数据,神经网络可以通过训练来拟合出输入和输出之间的关系。

MATLAB提供了fitnet函数,可以用于构建并训练一个前馈神经网络,并实现函数拟合。

例如,我们可以使用MATLAB生成一组正弦函数的样本数据,然后通过神经网络进行拟合。

首先,我们创建一个包含若干样本点的数据集,并将其划分为训练集和测试集。

然后,使用fitnet函数选择合适的网络结构和训练参数,并利用训练集对神经网络进行训练。

最后,使用测试集评估神经网络的拟合效果。

2. 数据挖掘问题数据挖掘是指从大量数据中提取有用信息的过程。

神经网络可以应用于数据挖掘问题,例如模式识别、分类、聚类等。

多层神经元网络一个网络可以有几层,每一层都有权重矩阵W,偏置向量b和输出向量a。

为了区分这些权重矩阵、输出矩阵等等,在图中的每一层,我们都为感兴趣的变量以上标的形式增加了层数。

你能够看到在下面所示的三层网络图和等式中使用层符号。

上面所示的网络有R1个输入,第一层有S1个神经元,第二层有S2个神经元,以次类推。

一般不同层有不同数量的神经元。

每一个神经元的偏置输入是常量1。

注意中间层的输出就是下一层的输入。

第二层可看作有S1个输入,S2个神经元和S1 xS2 阶权重矩阵W2 的单层网络。

第二层的输入是a1,输出是a2,现在我们已经确定了第二层的所有向量和矩阵,我们就能把它看成一个单层网络了。

其他层也可以照此步骤处理。

多层网络中的层扮演着不同的角色。

给出网络输出的层叫做输出层。

所有其他的层叫做隐层。

上图所示的三层网络有一个输出层(第三层)和两个隐层(第一和第二层)。

有些作者把输入作为第四层,这里不用这种指定。

上面所示的三层网络的简洁画法如下图所示:多层网络的功能非常强大。

举个例子,一个两层的网络,第一层的转移函数是曲线函数,第二层的转移函数是线性函数,通过训练,它能够很好的模拟任何有有限断点的函数。

这种两层网络集中应用于"反向传播网络"。

注意我们把第三层的输出a3标记为y。

我们将使用这种符号来定义这种网络的输出。

4.数据结构这一节将讨论影响网络仿真的输入数据结构的格式。

我们首先讨论静态网络,在讨论动态网络。

我们将关心两种基本的输入向量类型:同步(同时或者无时序)向量和异步向量。

对异步向量来说,向量的顺序是非常重要的。

对同步向量来说,顺序是不重要的,并且如果我们已经有一定数量的并行网络我们就能把一个输入向量输入到其中的任意网络。

静态网络中的同步输入仿真仿真静态网络(没有反馈或者延迟)是网络仿真最简单的一种。

在这种情况中,我们不需要关心向量输入的时间顺序,所以我们可以认为它是同时发生的。

用Deep Network Designer工具箱建立网络Deep Network Designer 工具箱可实现以下功能:导入、编辑网络从头建立新的网络通过拖拽方式增加网络层和连接(类似Simulink)查看、编辑网络层属性生成matlab代码1.打开App,导入网络在App标题栏中,点击Deep Network Designer 按钮即可打开工具箱,也可在命令窗中输入以下命令打开在开始界面,有一些预训练网络可供下载安装。

一般通过新建或从工作区导入的方式创建网络2.增加/编辑网络层App提供了常用的网络层模块,可通过拖拽的方式添加,软件自带的层模块有:输入层(图片/序列输入)、卷积和全连接层(二维/三维卷积)、池化层、序列层(lstm、gru、NLP处理)、激活函数(relu、elu、tanh等)、归一化等工具(BN、dropout)、目标检测、输出层。

另外,可以通过命令行自己建立新的层,并添加到网络中。

在工作区中点击每个层,可以查看修改层属性参数,也可选中各层进行复制、剪切、删除等操作。

3.分析网络点击Analyze按钮可以检查分析网络,检查网络结构是否有问题,分析各层的可学习参数数量,errors为0时,网络可用于训练。

4.使用Deep Network Designer进行训练首先在Data 栏中,点击Import Data 按钮导入训练集,然后在Training栏中,进行网络训练。

App中可对训练集进行数据增强,可设置训练参数。

5.网络导出也可将建好的网络导出到matlab工作区,通过 trainNetwork 命令进行训练。

也可先在App中训练完毕,将训练好的网络导出到工作区,这样导出的网络包含已学习的权重参数。

![[matlab工具箱]神经网络NeuralNet](https://img.taocdn.com/s1/m/1defa8ed710abb68a98271fe910ef12d2af9a9ae.png)

[matlab⼯具箱]神经⽹络NeuralNet//⽬的是学习在BP神经⽹络的基础上添加遗传算法,蚁群算法等优化算法来优化⽹络,这是后话。

先简单了解了MATLAB中的神经⽹络⼯具箱,⼯具箱功能还是⾮常强⼤的,已经可以拟合出⾮常多的曲线来分析了。

神经⽹络⼯具箱选择(4种)今天下载了⾃带的example跑了⼀次试⼀下选择隐藏神经元个数训练结束后可以在plot查看各种图表,这⾥只对⼯具箱操作做简单介绍最近⼀段时间在研究如何利⽤预测其销量个数,在⽹上搜索了⼀下,发现了很多模型来预测,⽐如利⽤回归模型、时间序列模型,GM(1,1)模型,可是⾃⼰在结合实际的⼯作内容,发现这⼏种模型预测的精度不是很⾼,于是再在⽹上进⾏搜索,发现神经⽹络模型可以来预测,并且有很多是结合时间序列或者SVM(⽀持向量机)等组合模型来进⾏预测,本⽂结合实际数据,选取了常⽤的BP神经⽹络算法,其算法原理,因⽹上⼀⼤堆,所以在此不必⼀⼀展⽰,并参考了这篇博⽂,运⽤matlab 2016a,给出了下⾯的代码,并最终进⾏了预测clcclear allclose all%bp 神经⽹络的预测代码%载⼊输出和输⼊数据load C:\Users\amzon\Desktop\p.txt;load C:\Users\amzon\Desktop\t.txt;%保存数据到matlab的⼯作路径⾥⾯save p.mat;save t.mat;%注意t必须为⾏向量%赋值给输出p和输⼊tp=p;t=t;%数据的归⼀化处理,利⽤mapminmax函数,使数值归⼀化到[-1.1]之间%该函数使⽤⽅法如下:[y,ps] =mapminmax(x,ymin,ymax),x需归化的数据输⼊,%ymin,ymax为需归化到的范围,不填默认为归化到[-1,1]%返回归化后的值y,以及参数ps,ps在结果反归⼀化中,需要调⽤[p1,ps]=mapminmax(p);[t1,ts]=mapminmax(t);%确定训练数据,测试数据,⼀般是随机的从样本中选取70%的数据作为训练数据%15%的数据作为测试数据,⼀般是使⽤函数dividerand,其⼀般的使⽤⽅法如下:%[trainInd,valInd,testInd] = dividerand(Q,trainRatio,valRatio,testRatio)[trainsample.p,valsample.p,testsample.p] =dividerand(p,0.7,0.15,0.15);[trainsample.t,valsample.t,testsample.t] =dividerand(t,0.7,0.15,0.15);%建⽴反向传播算法的BP神经⽹络,使⽤newff函数,其⼀般的使⽤⽅法如下%net = newff(minmax(p),[隐层的神经元的个数,输出层的神经元的个数],{隐层神经元的传输函数,输出层的传输函数},'反向传播的训练函数'),其中p为输⼊数据,t为输%tf为神经⽹络的传输函数,默认为'tansig'函数为隐层的传输函数,%purelin函数为输出层的传输函数%⼀般在这⾥还有其他的传输的函数⼀般的如下,如果预测出来的效果不是很好,可以调节%TF1 = 'tansig';TF2 = 'logsig';%TF1 = 'logsig';TF2 = 'purelin';%TF1 = 'logsig';TF2 = 'logsig';%TF1 = 'purelin';TF2 = 'purelin';TF1='tansig';TF2='purelin';net=newff(minmax(p),[10,1],{TF1 TF2},'traingdm');%⽹络创建%⽹络参数的设置net.trainParam.epochs=10000;%训练次数设置net.trainParam.goal=1e-7;%训练⽬标设置net.trainParam.lr=0.01;%学习率设置,应设置为较少值,太⼤虽然会在开始加快收敛速度,但临近最佳点时,会产⽣动荡,⽽致使⽆法收敛net.trainParam.mc=0.9;%动量因⼦的设置,默认为0.9net.trainParam.show=25;%显⽰的间隔次数%指定训练参数% net.trainFcn = 'traingd'; %梯度下降算法% net.trainFcn = 'traingdm'; %动量梯度下降算法% net.trainFcn = 'traingda'; %变学习率梯度下降算法% net.trainFcn = 'traingdx'; %变学习率动量梯度下降算法% (⼤型⽹络的⾸选算法)% net.trainFcn = 'trainrp'; % RPROP(弹性BP)算法,内存需求最⼩%共轭梯度算法% net.trainFcn = 'traincgf'; %Fletcher-Reeves修正算法% net.trainFcn = 'traincgp'; %Polak-Ribiere修正算法,内存需求⽐Fletcher-Reeves修正算法略⼤% net.trainFcn = 'traincgb'; % Powell-Beal复位算法,内存需求⽐Polak-Ribiere修正算法略⼤% (⼤型⽹络的⾸选算法)%net.trainFcn = 'trainscg'; % ScaledConjugate Gradient算法,内存需求与Fletcher-Reeves修正算法相同,计算量⽐上⾯三种算法都⼩很多% net.trainFcn = 'trainbfg'; %Quasi-Newton Algorithms - BFGS Algorithm,计算量和内存需求均⽐共轭梯度算法⼤,但收敛⽐较快% net.trainFcn = 'trainoss'; % OneStep Secant Algorithm,计算量和内存需求均⽐BFGS算法⼩,⽐共轭梯度算法略⼤% (中型⽹络的⾸选算法)%net.trainFcn = 'trainlm'; %Levenberg-Marquardt算法,内存需求最⼤,收敛速度最快% net.trainFcn = 'trainbr'; %贝叶斯正则化算法% 有代表性的五种算法为:'traingdx','trainrp','trainscg','trainoss', 'trainlm'%在这⾥⼀般是选取'trainlm'函数来训练,其算对对应的是Levenberg-Marquardt算法net.trainFcn='trainlm';[net,tr]=train(net,trainsample.p,trainsample.t);%计算仿真,其⼀般⽤sim函数[normtrainoutput,trainPerf]=sim(net,trainsample.p,[],[],trainsample.t);%训练的数据,根据BP得到的结果[normvalidateoutput,validatePerf]=sim(net,valsample.p,[],[],valsample.t);%验证的数据,经BP得到的结果[normtestoutput,testPerf]=sim(net,testsample.p,[],[],testsample.t);%测试数据,经BP得到的结果%将所得的结果进⾏反归⼀化,得到其拟合的数据trainoutput=mapminmax('reverse',normtrainoutput,ts);validateoutput=mapminmax('reverse',normvalidateoutput,ts);testoutput=mapminmax('reverse',normtestoutput,ts);%正常输⼊的数据的反归⼀化的处理,得到其正式值trainvalue=mapminmax('reverse',trainsample.t,ts);%正常的验证数据validatevalue=mapminmax('reverse',valsample.t,ts);%正常的验证的数据testvalue=mapminmax('reverse',testsample.t,ts);%正常的测试数据%做预测,输⼊要预测的数据pnewpnew=[313,256,239]';pnewn=mapminmax(pnew);anewn=sim(net,pnewn);anew=mapminmax('reverse',anewn,ts);%绝对误差的计算errors=trainvalue-trainoutput;%plotregression拟合图figure,plotregression(trainvalue,trainoutput)%误差图figure,plot(1:length(errors),errors,'-b')title('误差变化图')%误差值的正态性的检验figure,hist(errors);%频数直⽅图figure,normplot(errors);%Q-Q图[muhat,sigmahat,muci,sigmaci]=normfit(errors);%参数估计均值,⽅差,均值的0.95置信区间,⽅差的0.95置信区间[h1,sig,ci]= ttest(errors,muhat);%假设检验figure, ploterrcorr(errors);%绘制误差的⾃相关图figure, parcorr(errors);%绘制偏相关图运⾏之后的,结果如下:BP神经⽹络的结果分析图训练数据的梯度和均⽅误差之间的关系图验证数据的梯度与学习次数残差的正态的检验图(Q-Q图)在⽹上,发现可以通过神经⽹络⼯具箱这个GUI界⾯来创建神经⽹络,其⼀般的操作步骤如下:1:在输⼊命令⾥⾯输⼊nntool命令,或者在应⽤程序这个选项下找到Netrual Net Fitting 这个应⽤程序,点击打开,就能看见如下界⾯2:输⼊数据和输出数据的导⼊(在本⽂中选取了matlab⾃带的案例数据)3:随机选择三种类型的数据所占的样本量的⽐例,⼀般选取默认即可4:隐层神经元的确定5:训练算法的选取,⼀般是选择默认即可,选择完成后点击<train>按钮即可运⾏程序6:根据得到的结果,⼀般是MSE的值越⼩,R值越接近1,其训练的效果⽐较,并第⼆张图给出了神经⽹络的各参数的设置以及其最终的结果,其拟合图R越接近1,模型拟合的更好最终的结果图7:如果所得到的模型不能满⾜你的需求,则需重复上述的步骤直⾄能够得到你想要的精确度8:将最终的得到的各种数据以及其拟合值进⾏保存,然后查看,就可以得到所要的拟合值最后参考了⽹上和MATLAB的帮助,给出了⼀些与神经⽹络相关的函数,希望能够帮助⼤家。

BP神经网络的仿真实验一、实验目的学会用matlab的神经网络工具箱(Nntool)来完成神经网络可逼近函数的功能。

二、实验任务设计一个两层的BP神经网络。

输入范围为[-1 1],样本输入x和目标输出y为:x=-1:0.01:1;y=(1-x2)1/2训练该网络使输出在区间[-1 1] 内逼近该函数。

三、实验要求:通过仿真画出y=(1-x2)1/2 和在样本输入x的情况下神经网络输出的图形,分析你所设计的神经网络的逼近性能如何?四、实验步骤及结果1实验步骤1) 在Matlab的命令窗口下键入Nntool,2) 我们就进入了神经网络工具箱的Network/Data Manager窗口:2)点击Network/Data Manager窗口下部的New Network,3)进入Create New Network窗口,4)该窗口的每一个设置参数如图所示:3)输入神经网络的输入向量和目标向量:在Matlab命令窗口中定义好所需要的输入向量和目标向量,再传送到工具箱中,具体操作为在命令窗口键入以下命令行:>> x=-1:0.01:1;>> y=sqrt(1-x.^2);这样就定义好了输入向量和目标向量。

点击Network/Data Manager窗口下的Import 按钮,进入Import or Load to Network/Data Manager窗口:由于数据来自于工作空间,所以Source项取默认值;如果数据来自于disk,则选择Load from disk file。

在Select a variable中选择想要传送的数据x,再在destination项中键入名字x,同时import as中的选项被激活了,选择其中的Inputs,最后点击Import,这样就完成了输入向量从工作空间向工具箱的传送,在Network/Data Manager窗口下的Inputs列表中出现了新输入的输入向量的名字x;同理可以输入目标向量y。